Chapter 3: 촉각의 가치 — 왜 힘 정보가 필수인가

요약

촉각 정보의 추가는 로봇 조작 성능을 일관되게 향상시킨다: OSMO [#18] +16%p, VTDexManip +20%, ForceVLA [#1] +23.2%p, UMI-FT [#36] +76%p. 넓은 커버리지의 단순 센서가 좁은 영역의 고해상도 센서보다 효과적이라는 반직관적 발견(Ye et al. binary touch, seen objects 기준 85%)은 TacGlove [#26]의 "8개 3축 센서" 설계를 정당화한다. 본 장에서는 촉각 추가의 정량적 가치, 센서 선택의 trade-off, 그리고 Embodiment Bridge 개념을 분석한다.

3.1 도입: 시각만으로 충분한가

Chapter 2에서 확인했듯이, 현재까지의 대규모 인간 데이터 수집(EgoDex, Ego4D, BuildAI)과 대부분의 학습 파이프라인(EgoMimic, EgoScale, AoE)은 시각 정보에만 의존한다. 이 접근이 상당한 성과를 거두었음은 사실이다 — EgoScale은 20,854시간의 시각 데이터만으로 +54%의 성능 향상과 log-linear scaling law를 실증했다.

그러나 시각만으로는 답할 수 없는 질문이 있다: "이 물체를 얼마나 세게 잡아야 하는가?" "미끄러지고 있는가?" "표면이 딱딱한가 부드러운가?" 이 정보가 없을 때, 로봇은 contact-rich 태스크에서 체계적으로 실패한다.

정량적 증거: EgoZero [5]는 시각만으로 7개 태스크에서 평균 70% 성공률을 달성했지만, 이는 산업 적용에 필요한 95%+ 수준에 크게 미달한다. AoE [6]는 vision-only co-training으로 Push Bowl & Pour Seed 태스크에서 겨우 20%를 기록했다 — contact-rich 태스크에서의 시각 한계가 가장 선명하게 드러나는 사례이다.

3.2 촉각 추가의 정량적 가치

OSMO: +16%p (실세계, 촉각 글러브)

OSMO [1] [#18]는 동일한 실험 조건에서 모달리티별 성능을 직접 비교한 유일한 대규모 연구이다.

| 모달리티 조합 | 성공률 | 표준편차 |

|---|---|---|

| Proprioception only | 27.12% | ±32.38% |

| Vision + proprioception | 55.75% | ±30.01% |

| Tactile + vision + proprioception | 71.69% | ±27.43% |

촉각 추가 효과: +15.94%p (vision+proprio 대비). 동시에 표준편차가 30.01%에서 27.43%로 감소하여, 촉각이 성능 향상뿐 아니라 안정성 향상에도 기여함을 보여준다.

다만 이 결과는 단일 태스크(wiping)에서 140 demos(약 2시간)로 달성되었다는 점에서, 일반화 가능성은 추가 검증이 필요하다. Wiping은 sustained contact pressure가 필요한 태스크로, 촉각에 유리한 조건이다. 대조적으로, pick-and-place 같은 단순 태스크에서 동일 효과가 나타나는지는 미검증이다.

VTDexManip: +20% per modality (시뮬레이션, binary)

VTDexManip [5]은 6개 dexterous manipulation RL 벤치마크에서 모달리티별 기여를 분리했다:

- Vision only → baseline

- + Binary tactile → +~20%

- + Joint visual-tactile pretraining → 추가 +~20%

핵심 발견은 binary(접촉/비접촉) 수준의 조악한 촉각 정보만으로도 유의미한 향상이 있다는 것이다. 이는 촉각의 가치가 고해상도 힘 측정에만 있는 것이 아님을 시사한다.

한계: 시뮬레이션 기반이므로 실세계에서의 효과 재현은 별도 검증이 필요하다.

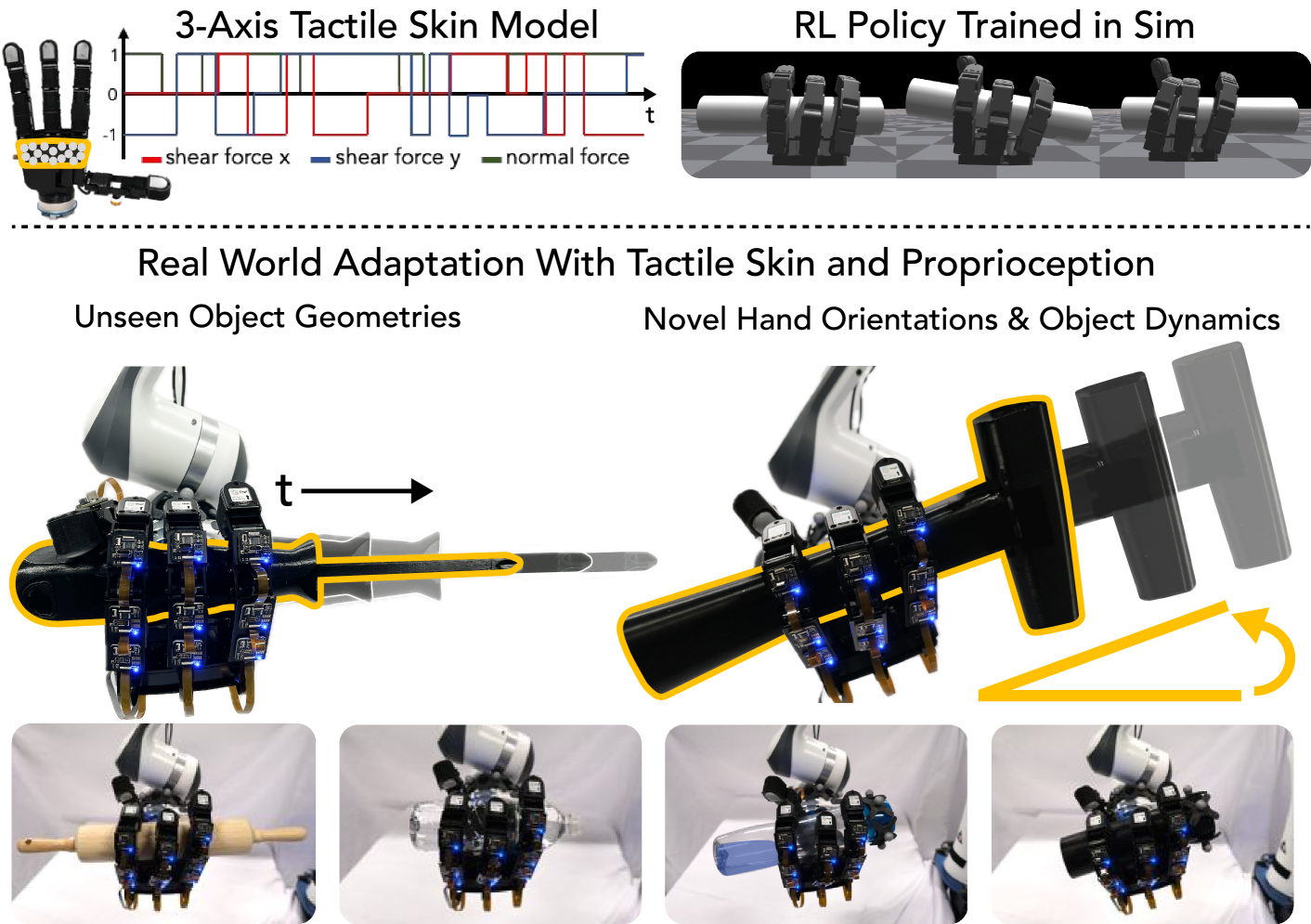

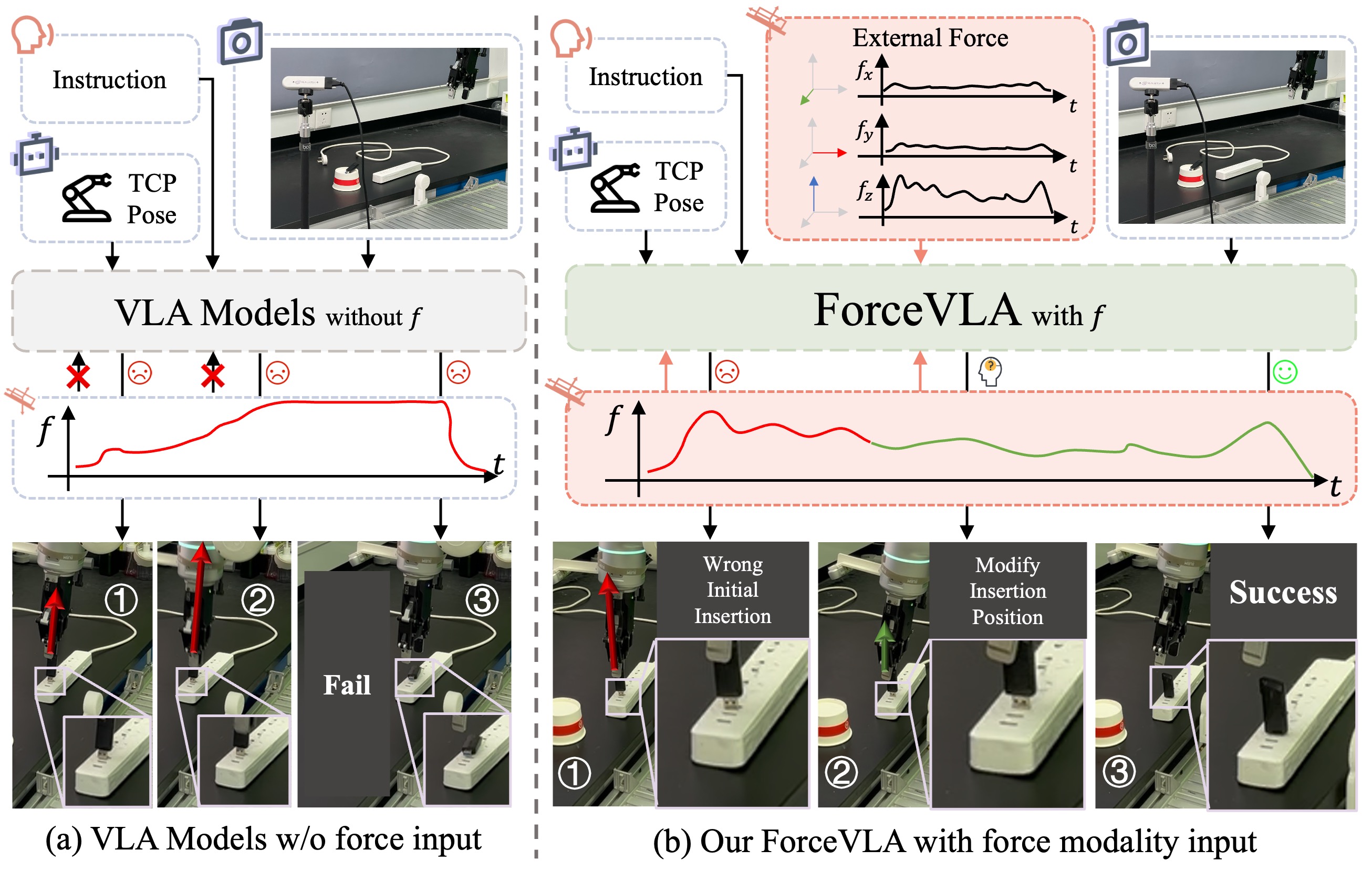

ForceVLA: +23.2%p (시각 기반 힘 추정)

ForceVLA [#1]는 직접적 촉각 센서 대신 시각에서 힘을 추정하는 간접적 접근을 취했다. 시각 기반 힘 추정을 VLA에 통합하여 +23.2%p의 성능 향상을 달성했다. 이 결과는 "힘 정보 자체의 가치"를 방법론과 독립적으로 입증한다 — 센서가 아닌 추정값으로도 유의미한 향상이 있다면, 직접 촉각 센서의 잠재적 가치는 더 클 것이다.

DexUMI: 촉각 없으면 grasping 실패

DexUMI [4] [#8]의 ablation은 가장 직접적인 촉각 필수성 근거를 제공한다. 촉각 센서가 있는 정책은 grasping에 성공했지만, 촉각을 제거하면 실패했다. 이것은 wearable capture 시스템에서의 촉각 필수성을 실세계에서 입증한 유일한 결과이다.

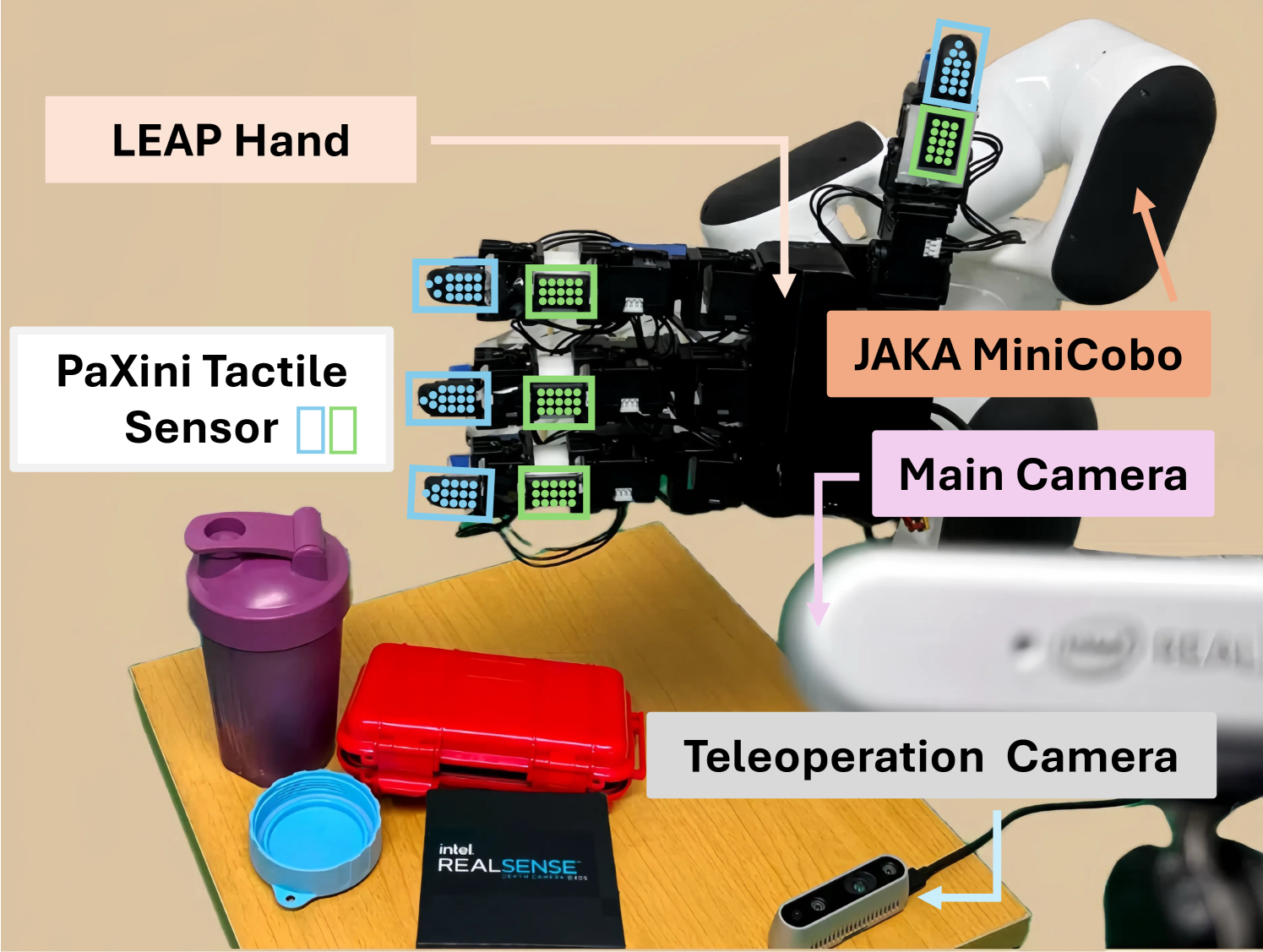

Ye et al.: Binary touch로 85% (Science Robotics, 2026)

Ye et al.[3]은 LEAP Hand에 binary touch 센서와 표준 웹캠만으로 seen tasks 85%, all tasks 73%의 성공률을 달성했다. Visual-tactile self-supervised pretraining이 핵심 기법이며, 학습 효율, sim-to-real gap 감소, 미지 태스크 일반화 모두에서 향상을 보고했다.

UMI-FT: 0%→92% (실세계, 손목 F/T)

UMI-FT [10] [#36]는 촉각 추가의 극적 효과를 가장 선명하게 보여주는 사례이다. 화이트보드 닦기에서 위치 제어(DP)만 사용 시 16%, 힘 센싱+적응형 컴플라이언스(ACP) 추가 시 92% — +76%p 향상. 전구 삽입에서는 0%→95%로 촉각 없이는 완전 불가능한 태스크가 가능해짐. CoinFT라는 손가락당 6축 F/T 센서 1개(총 2개)만으로 이 결과를 달성했다는 점에서, 최소한의 힘 센싱으로도 contact-rich 태스크의 성패를 좌우할 수 있음을 입증한다.

EquiTac: 10 demos로 90% (등변 촉각)

EquiTac [11] [#37]는 GelSight 표면 법선맵의 SO(2)-등변 구조를 활용하여, 10개 시연만으로 90% 성공률을 달성했다(baseline 60개 시연으로 최대 75%). 촉각 데이터의 기하학적 대칭성을 이용한 샘플 효율성의 극적 향상으로, 촉각이 단순한 성능 향상뿐 아니라 데이터 효율성에도 기여할 수 있음을 보여준다.

종합 비교

| 연구 | 촉각 유형 | 향상폭 | 환경 | 한계 |

|---|---|---|---|---|

| OSMO | 3축 자기 | +16%p | Real, 1태스크 | 소규모, 단일 태스크 |

| VTDexManip | Binary piezoresistive | +20%/modality | Sim | Real 미검증 |

| ForceVLA | 시각 기반 추정 | +23.2%p | Sim/Lab | 간접 추정 |

| DexUMI | 센서 통합 | 필수 (없으면 실패) | Real | 4태스크 |

| Ye et al. | Binary touch | 85% (seen objects) | Real | LEAP Hand 한정 |

| UMI-FT | 손목 6축 F/T | +76%p (0%→92%) | Real | 2-finger gripper |

| EquiTac | GelSight SO(2)-등변 | 10 demos→90% | Real | 단일 태스크 |

3.3 넓은 커버리지 vs 높은 해상도

촉각 센서 설계에서 핵심 trade-off는 센서 밀도(해상도) vs 공간적 커버리지이다. 인간 피부는 손끝에 약 2,500개/cm²의 기계수용기를 가지지만, 현재 기술로 이를 글러브에 재현하는 것은 불가능하다.

Ye et al.[3]의 결과는 이 trade-off에 대한 명확한 답을 제공한다: binary touch(접촉/비접촉)만으로 seen objects 기준 85% 성공률(전체 평균 73%). 이는 GelSight 수준의 고해상도 촉각(수백~수천 taxel)이 반드시 필요하지 않음을 의미한다.

현재까지의 결과를 해상도 스펙트럼으로 정리하면: 손끝 다축(EquiTac/TacCap) → whole-hand 중해상도(OSMO/TacGlove) → 손목 집계(UMI-FT). UMI-FT의 CoinFT는 손가락당 6축 F/T 1개(총 2개)로 해상도가 가장 낮지만, contact-rich 태스크에서 0%→92%의 극적 효과를 보였다. OSMO의 12개 3축 센서가 +16%p를, Ye et al.의 binary 센서가 85%를 달성한 것을 종합하면, "넓은 커버리지의 moderate-resolution 센서 > 좁은 영역의 high-resolution 센서"라는 설계 원칙이 도출된다.

"손끝 + 손바닥"이라는 분포 자체가 얼마나 중요한지는 [12]이 정량화했다. DRL 기반 in-hand reorientation 벤치마크에서 upper-palm 위치의 촉각 센서 기여도(consecutive successes 27.87)가 fingertip distal phalanges(28.21)와 사실상 동등했으며, 소형 객체 설정에서는 손바닥 5개 위치를 모두 사용한 구성이 전 구성 중 최고 점수를 기록했다. 비전 단일 대비 촉각을 추가했을 때 성공률 +26%, 수렴 속도 3배 가속도 함께 보고됐다. 즉 "손바닥은 보조적이고 손끝이 주역"이라는 오래된 직관은 정량적으로 기각되며, 손바닥은 최소한 손끝과 동등한 효용을 가진다. Sparsh-skin [13]의 어블레이션(손바닥 패드 제거 시 pose estimation 10%p+ 하락)도 같은 방향을 가리킨다.

이 원칙은 TacGlove [#26]의 설계를 직접 정당화한다: 8개의 3축 자기 센서를 손가락과 손바닥에 분산 배치하여 whole-hand 커버리지를 확보하되, 개별 센서의 해상도는 moderate 수준으로 유지한다. 24채널(8센서 × 3축)의 연속 힘 데이터는 binary보다 풍부하면서도 고밀도 어레이보다 실용적이다. 5손가락 끝 + 3손바닥 섹션(thenar/hypothenar/central) 배치는 Almeida et al.의 "손바닥 위치는 소형 객체에서 지배적"이라는 결과와 직접 부합한다.

그러나 중요한 미해결 질문이 있다: 산업 태스크(캡핑, 조립)에서 3축 연속 힘이 binary 대비 유의미하게 우월한가? 캡핑은 특정 토크와 법선력의 정밀 제어가 필요하고, 이는 binary 정보로는 부족할 수 있다. 이 질문은 TacTeleOp의 필수 ablation 실험 중 하나이다 (Chapter 10).

3.4 Embodiment Bridge: 촉각이 해소하는 gap

OSMO [1]가 제시한 Embodiment Bridge는 촉각의 가치를 성능 향상 이상으로 확장한다. 동일한 물리적 촉각 글러브를 인간과 로봇 모두에 장착하면:

- 촉각 공간의 물리적 통일: 인간이 느끼는 접촉 패턴과 로봇이 느끼는 접촉 패턴이 동일 센서에서 생성되므로, 촉각 cross-embodiment gap이 물리적으로 해소된다.

- 시각 gap의 부분 해소: 글러브가 양쪽의 외관을 부분적으로 통일한다.

- 데이터 정렬의 단순화: 인간 데이터와 로봇 데이터가 동일 센서 공간에서 생성되므로, 복잡한 domain adaptation이 불필요하다.

그러나 OSMO의 Embodiment Bridge는 수동적(passive)이다 — 데이터를 정렬할 뿐, 로봇이 능동적으로 gap을 학습하지는 않는다. TacPlay [#27]는 이를 능동적(active) 학습으로 확장한다: 인간의 촉각 패턴을 "목표"로 설정하고, 로봇이 자율 play를 통해 자신의 기구학으로 이를 재현하는 방법을 탐색한다 (Chapter 9).

3.5 센서 선택 가이드

본 서베이의 분석에 기반한 촉각 센서 선택 기준:

| 기준 | 권장 | 근거 |

|---|---|---|

| 축 수 | 3축 (법선 + 전단) | 전단력 없이는 미끄러짐 감지 불가 |

| 커버리지 | Whole-hand (손끝 + 손바닥) | Ye et al.: 커버리지 > 해상도. Sparsh-skin 어블레이션: 손바닥 제거 시 pose estimation −10%p |

| 인간/로봇 공용 | 필수 | OSMO Embodiment Bridge |

| 내구성 | 세척·교대 교체 가능 | 공장 8시간 연속 운용 |

| 비용 | <$1,000/글러브 | AirExo $600 대비 경쟁력 |

| EMI 내성 | 필요 시 차폐 | 공장 환경 전자기 간섭 |

자기 센서(OSMO 방식)는 이 기준 대부분을 충족한다. MuMetal 차폐와 이중 자력계 차동 센싱으로 노이즈를 57% 줄인 OSMO의 설계를 참조하되, 공장 환경의 전자기 간섭은 사전 측정과 추가 차폐로 대응해야 한다.

3.6 손바닥 신호 기반 closed-loop 제어

지금까지의 증거는 대부분 촉각이 관측(observation)으로서 정책 성능을 높인다는 논지였다. 그러나 최근 연구는 한 단계 더 나아가, 손바닥 촉각 신호 자체가 액추에이션을 직접 구동하는 closed-loop control trigger로 작동할 수 있음을 보였다.

[14]의 TacPalm SoftHand는 소프트 로봇 손의 손바닥에 1280×800 micro-camera 기반 시각 촉각을 내장하여 유효 밀도 181,000 units/cm²(사람 손 기계수용기 밀도의 약 750배)를 달성한다. 이 손바닥 영상에서 계산되는 Indentation Contour Area(ICA)가 사전 정의한 임계값을 초과하는 순간 손가락의 pneumatic inflation이 자동 트리거되도록 설계되어, 외부 시각 입력이나 상위 플래너의 명령 없이 손바닥 신호만으로 파지 루프가 닫힌다. 이는 손바닥이 "물체가 손 안에 자리 잡았는지"를 직접 판정하고 즉시 fingers를 수축시키는 구조로, 촉각을 행동 변수(action trigger)로 승격시킨 최초의 대규모 하드웨어 구현에 해당한다.

같은 방향의 시스템적 증거로 [15]의 F-TAC Hand가 있다. 손바닥 70%를 0.1 mm 해상도로 커버한 상태에서 multi-object delivery를 수행한 결과, 촉각 부재 시 53.5%에 머물던 적응률이 고해상도 손바닥 촉각이 active일 때 거의 100%로 상승한다. 이 격차는 손바닥 접촉 신호가 충돌 회피와 재배치 결정에 직접 기여함을 의미하며, 단순한 성능 향상이 아니라 loop closure의 존재 자체를 입증한다.

TacTeleOp·TacPlay 관점에서 이 결과는 중요한 시사점을 준다: 촉각 채널이 추가된 순간 로봇은 passive learner가 아니라 reactive actor가 될 수 있다 (Chapter 8, Chapter 9). TacGlove가 제공하는 24채널 연속 힘 데이터는 이런 closed-loop 정책의 입력으로 충분히 rich하며, palm-side thenar/hypothenar/central 배치는 TacPalm·F-TAC이 보여준 "손바닥 = 의사결정 지점"이라는 원칙을 하드웨어 수준에서 재현한다.

3.7 핵심 논의: 촉각은 과연 필수인가

촉각의 가치에 대한 반론도 존재한다:

- "AirExo-2는 촉각 없이 teleop 수준 달성": 이 주장은 부분적으로 타당하나, AirExo-2는 arm-level gripper 태스크에 한정된다. DexUMI ablation이 보여주듯, dexterous hand + contact-rich 태스크에서는 촉각 없이 grasping이 실패한다. 태스크 복잡도가 촉각 필요성의 결정 요인이다.

- "pi0 규모에서 emergent alignment이 촉각 gap도 해소": pi0 [8] [#2]에서 관찰된 emergent alignment은 시각 modality에서만 확인되었고, 촉각에서의 emergent alignment은 미탐색이다. 더 중요하게, pi0는 산업 규모 compute를 요구하므로 학술 연구실에서 재현이 불가능하다.

- "Binary touch로 85%면 3축 센서는 과잉": Ye et al.의 85%는 lab 환경의 seen tasks 기준이다. 산업 공정에서 정밀 토크 제어(캡핑)나 힘 크기 구분(조립 시 부품 끼워넣기)이 필요한 경우, binary 정보만으로는 부족할 수 있다. 이것은 가설이며, TacTeleOp의 3축 vs binary ablation으로 검증이 필요하다.

결론: 촉각의 필요성은 태스크 의존적이다. 단순 pick-and-place에서는 시각만으로 충분할 수 있지만, contact-rich 산업 태스크에서는 촉각이 70% ceiling을 95%+로 끌어올리는 핵심 modality가 된다.

3.8 우리의 방향과의 연결

TacGlove의 촉각 추가는 세 가지 층위에서 정당화된다:

- 성능 향상: OSMO +16%p, VTDexManip +20%, DexUMI "필수"의 일관된 증거

- Embodiment Bridge: 동일 글러브로 인간-로봇 gap의 물리적 해소 (Chapter 6, Chapter 9)

- Scaling law 탐색: 촉각 데이터의 scaling 특성은 아직 누구도 검증하지 않은 열린 질문 (Chapter 10)

Part I의 세 장을 종합하면: 텔레오퍼레이션은 구조적 병목이 있고(Chapter 1), 대안적 수집 하드웨어는 촉각이 빠져 있으며(Chapter 2), 촉각은 contact-rich 태스크에서 필수적이다(Chapter 3). 이것이 TacGlove/TacTeleOp/TacPlay의 출발점이다. Part II에서는 수집된 사람 데이터를 로봇 정책으로 전환하는 방법론을 분석한다 (Chapter 4).

참고문헌

- Yin, J., et al. (2025). OSMO: A Large-Scale Tactile Glove for Human-to-Robot Manipulation Transfer. arXiv. https://arxiv.org/abs/2512.08920 #18 scholar

- Liu, Q., et al. (2025). VTDexManip: Visual-Tactile Dexterous Manipulation Dataset and Benchmark. ICLR 2025. scholar

- Ye, Q., et al. (2026). Visual-Tactile Learning for Dexterous Manipulation. Science Robotics. scholar

- Xu, M., et al. (2025). DexUMI: Universal Manipulation Interface for Dexterous Hands. arXiv. #8 scholar

- Liu, V., et al. (2025). EgoZero: Robot Policy Learning from Egocentric Video without Robot Data. arXiv. scholar

- Yang, B., et al. (2026). AoE: Always-on Egocentric Data Collection for Robot Learning. arXiv. scholar

- Zheng, R., et al. (2026). EgoScale: Egocentric Video Pretraining for Scalable Robot Learning. arXiv. scholar

- Physical Intelligence (2025). pi0: A General-Purpose Robot Policy. arXiv. #2 scholar

- Park, M., & Park, Y.-L. et al. (2024). Stretchable Glove for Hand Motion Estimation. Nature Communications. #6 scholar

- Kim, T., et al. (2026). UMI-FT: Compliant Manipulation via Universal Manipulation Interface with Force/Torque Sensing. arXiv. #36 scholar

- Kim, M., et al. (2025). EquiTac: Tactile Equivariance for Efficient Manipulation Learning. arXiv. #37 scholar

- Almeida, J. D., Falotico, E., Laschi, C., & Santos-Victor, J. (2025). The Role of Touch: Towards Optimal Tactile Sensing Distribution in Anthropomorphic Hands for Dexterous In-Hand Manipulation. IEEE ICNSC 2025. https://arxiv.org/abs/2509.14984 #41 scholar

- Sharma, A., et al. (2025). Self-supervised perception for tactile skin covered dexterous hands (Sparsh-skin). arXiv. https://arxiv.org/abs/2505.11420 scholar

- Zhang, N., Ren, J., Dong, Y., Gu, G., & Zhu, X. (2025). Soft Robotic Hand with Tactile Palm-Finger Coordination (TacPalm SoftHand). Nature Communications 16:2395. https://doi.org/10.1038/s41467-025-57741-6 #40 scholar

- Zhao, Z., et al. (2025). Embedding high-resolution touch across robotic hands enables adaptive human-like grasping (F-TAC Hand). Nature Machine Intelligence. https://arxiv.org/abs/2412.14482 #39 scholar