Chapter 4: 사람 데이터만으로 가능한가 — Teleop-Free 접근

요약

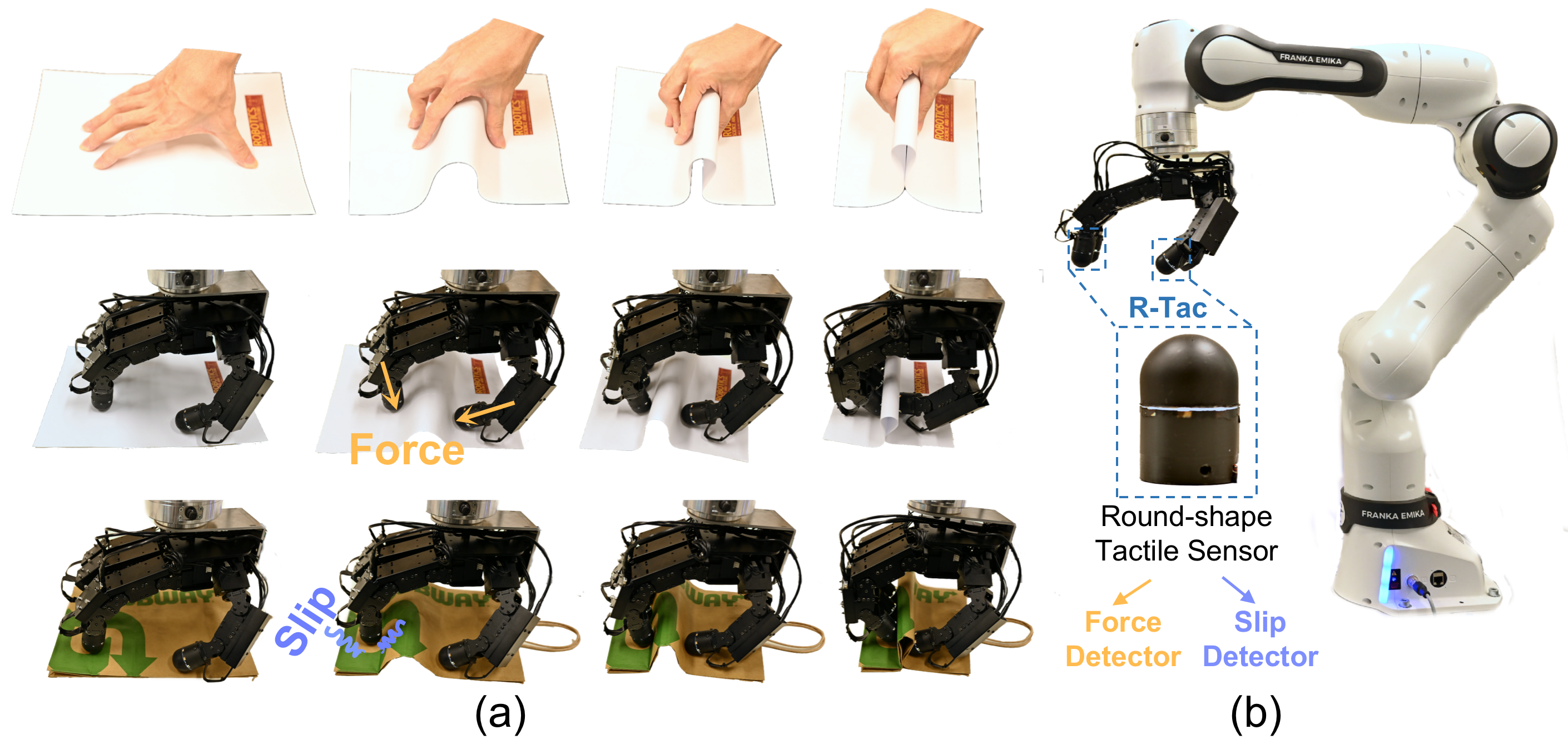

2025년을 기점으로 인간 데이터만으로(zero robot data) 로봇 조작 정책을 학습하는 것이 가능해졌다. X-Sim은 RGBD 1개로, Human2Sim2Robot은 시연 1개로, EgoZero는 스마트글래스만으로 실세계 전이를 달성했다. 그러나 이 접근들은 contact-rich 태스크에서 체계적 한계를 보이며, 검증된 태스크 범위가 5~13개에 제한된다. 이 한계가 Data A(텔레오퍼레이션 데이터) + Data B(사람 손 데이터) co-training(Chapter 5)과 촉각 정보(Chapter 3)의 필요성을 강화한다.

4.1 도입

"인간 데이터만으로 로봇 제어가 가능한가?"는 TacTeleOp [#26]의 가설 H1에 해당하는 질문이다. 2024년까지 이 답은 대체로 부정적이었다. 인간과 로봇의 기구학, 시각, 동역학 차이(embodiment gap)가 너무 커서 직접 전이가 불가능하다고 여겨졌다. 그러나 2025년에 이 가정을 뒤집는 연구가 연달아 등장했다.

4.2 Real-to-Sim-to-Real: 시뮬레이션을 경유하는 접근

X-Sim (Cornell, CoRL 2025 Oral)

X-Sim [1]은 인간 RGBD 비디오 1개에서 출발하여 로봇 정책을 학습하는 3단계 파이프라인을 제시했다: (1) photorealistic simulation 재구성 + 물체 궤적 추출, (2) 물체 궤적을 embodiment-agnostic 보상으로 사용하여 시뮬레이션에서 RL 훈련, (3) 다양한 시점/조명으로 합성 롤아웃 생성 후 diffusion policy로 증류.

| 지표 | 수치 |

|---|---|

| Task progress 향상 | +30% (baselines 대비) |

| 데이터 수집 시간 | BC 대비 10x 절감 |

| 입력 | 인간 RGBD 비디오 1개 |

| Robot data | 0 |

X-Sim의 핵심 통찰은 물체 궤적을 보상으로 사용하는 것이다. 인간이 물체를 어떻게 움직였는지(물체 중심 표현)는 embodiment-agnostic하므로, 인간-로봇 기구학 차이와 무관하게 보상 신호로 기능한다.

한계: (1) RGBD 입력이 필수여서 RGB-only보다 접근성이 낮다. (2) 5개 태스크만 검증되었으며 contact-rich 태스크(나사 조이기 등)가 미포함. (3) 물체 중심 보상이므로 도구 사용이나 변형 물체 태스크에 약할 가능성. (4) Gripper 기반으로 dexterous hand 미검증.

Human2Sim2Robot (Stanford, CoRL 2025)

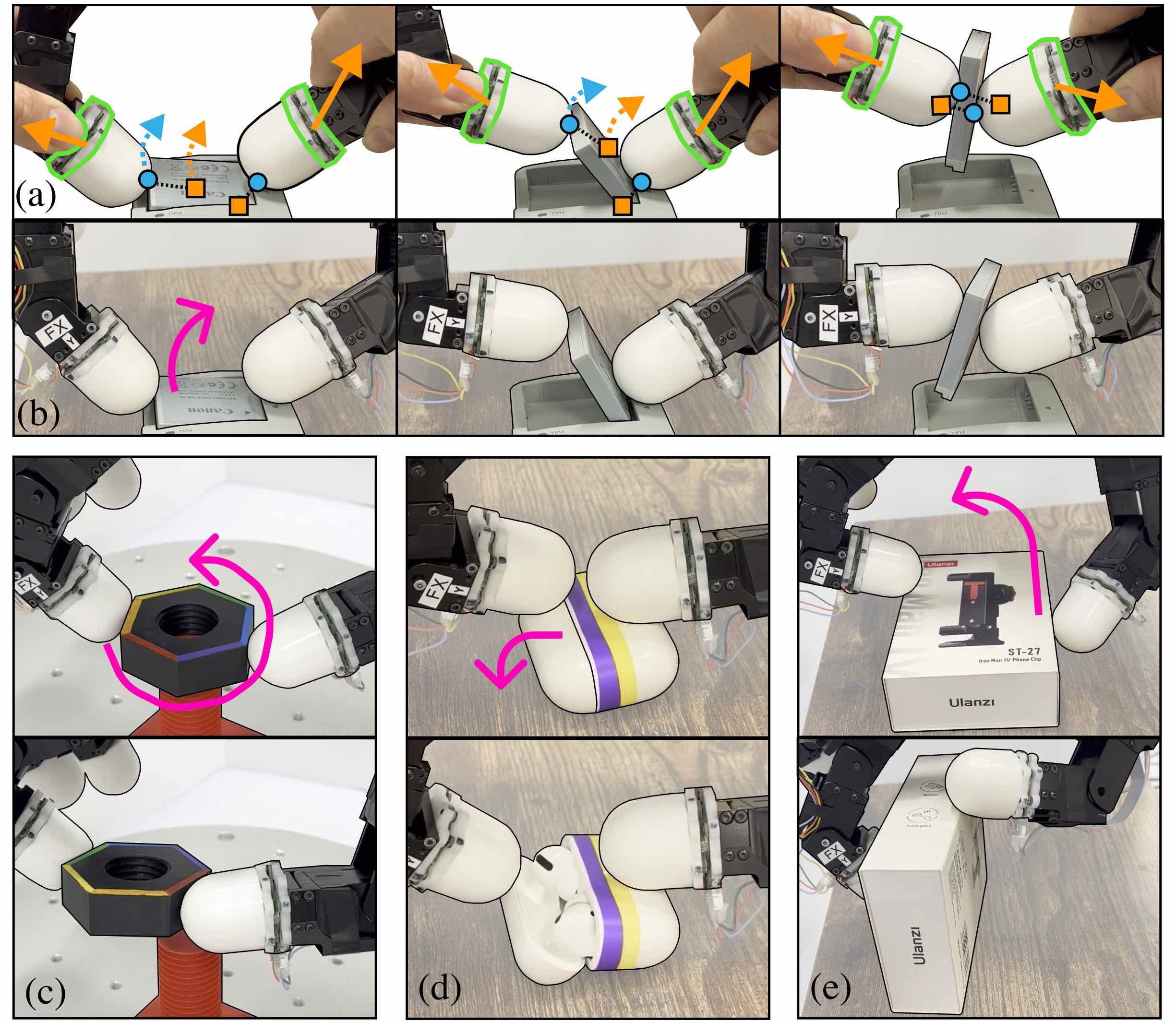

Human2Sim2Robot [2]은 인간 RGB-D 비디오 1개에서 dexterous hand(Allegro) 정책을 학습했다. 물체 6D pose trajectory를 dense reward로 사용하고, pre-manipulation hand pose로 RL 탐색을 초기화한다.

| Baseline 대비 | 향상폭 |

|---|---|

| vs Replay | +67% |

| vs Object-Aware Replay | +55% |

| vs BC (data augmentation) | +68% |

7개 실세계 태스크(KUKA + Allegro Hand)에서 10회 rollout으로 평가. Ablation에서 object pose trajectory가 hand tracking reward보다 안정적임을 확인했다 — hand tracking은 pose estimation 오류가 전파되기 때문이다.

저자가 명시한 한계: (1) KUKA + Allegro에만 검증. (2) 강체 물체만 지원. (3) 대칭/반사 물체의 pose 추정 모호성. (4) 단일 물체/단일 태스크 정책. (5) 디지털 트윈 재구성이 환경마다 필요.

TacPlay [#27] 연결: "pose estimation 노이즈"라는 저자 인정 한계는 촉각이 보완할 수 있는 영역이다. 접촉면에서의 직접 촉각 측정은 시각 기반 pose estimation의 occlusion과 노이즈를 우회한다.

4.3 Zero Robot Data: 시뮬레이션 없이 직접 전이

EgoZero (NYU/Berkeley, 2025)

EgoZero [3]는 Project Aria 스마트글래스에서 egocentric 인간 시연을 수집하여, zero robot data로 manipulation policy를 학습했다. Egocentric 3D point 기반 unified state-action space가 핵심이다 — 인간과 로봇의 기구학 차이를 3D point 공간에서 추상화하여 morphology-agnostic한 표현을 만든다.

| 지표 | 수치 |

|---|---|

| 성공률 (7태스크 평균) | 70% |

| 태스크당 수집 시간 | 20분 |

| Robot data | 0 |

EgoZero의 70%는 "사람 데이터만으로도 상당한 수준에 도달 가능"함을 보여주지만, 동시에 30%의 실패가 존재함을 의미한다. 산업 적용에 필요한 95%+와의 격차(25%p)가 촉각과 co-training의 역할 공간이다.

한계: Franka Panda gripper만 검증, dexterous hand 미지원, Project Aria(Meta 독점) 의존, 촉각/힘 정보 완전 부재.

VidBot (TU Munich/ETH, CVPR 2025)

VidBot [4]은 in-the-wild monocular RGB 인간 비디오에서 3D affordance를 학습한다. Depth foundation model + structure-from-motion으로 metric-scale 3D hand trajectory를 재구성하고, diffusion model로 fine-grained interaction trajectory를 생성한다. 13개 태스크에서 기존 방법 대비 약 +20%의 향상을 보고했다.

RGB만으로 zero-shot 전이가 가능하다는 점은 인상적이나, force 정보가 완전히 부재하여 contact-rich 태스크에서의 ceiling이 예상된다.

4.4 사전훈련 기반 접근

LAPA (ICLR 2025)

LAPA [5]는 VQ-VAE로 프레임 간 discrete latent action을 학습하고, 이를 VLA pretrain에 사용한 후 소량 로봇 데이터로 fine-tune하는 파이프라인이다.

| 실험 | LAPA | OpenVLA | 차이 |

|---|---|---|---|

| Real-world avg | 50.1% | 43.9% | +6.2%p |

| Unseen objects | 57.8% | 46.2% | +11.6%p |

| 계산 비용 | 272 H100-hr | 21,500 A100-hr | ~30x 효율 |

LAPA의 "인간 비디오 pretrain이 robot data보다 효율적"이라는 결론은 TacTeleOp의 B pretrain → A fine-tune 구조를 직접 지지한다. 그러나 cross-environment 일반화에서 약함(Language Table 33.6% vs ActionVLA 64.8%)과 grasping 등 세밀한 모션에서의 한계가 보고되었다.

VideoDex (CMU, CoRL 2023 / IJRR 2024)

VideoDex [Shaw et al., 2023/2024]는 인터넷 비디오에서 hand motion을 추출하여 LEAP Hand로 retarget하고, pretrained visual embeddings + Neural Dynamical Policies로 학습했다. "인간 비디오 → 로봇 dexterous 정책" 패러다임의 선구자이나, fine-tuning에 태스크당 120~175 demos가 필요하다는 한계가 있다.

4.5 비교 분석: Teleop-Free 접근의 현황

| 논문 | 방법 | 입력 | Robot Data | 핵심 결과 | Contact-rich |

|---|---|---|---|---|---|

| X-Sim | Sim RL + object reward | 1 RGBD | 0 | +30% | 미검증 |

| Human2Sim2Robot | Sim RL + pose reward | 1 RGB-D | 0 | +55-68% | 부분 |

| EgoZero | 3D point policy | Aria glasses | 0 | 70% | 미검증 |

| VidBot | 3D affordance | Monocular RGB | 0 | +20% | 미검증 |

| LAPA | Latent action pretrain | Internet video | 소량 | 30x 효율 | 약함 |

| VideoDex | Retarget + pretrain | Internet video | 120-175/task | pretrain 효과 | 미검증 |

| UMI | 핸드헬드 그리퍼 | Diffusion Policy | 0 robot data | 컵 100%, 던지기 87.5%, 야외 71.7% | No |

| ACT-1 | Skill Capture Glove | Skill Transform+모델 | 0 robot data | 33종 조작, Airbnb zero-shot | No |

패턴 분석

- 2025년이 전환점: 모든 zero-robot-data 연구가 2025년에 집중되었다.

- 시각 중심 보상이 지배적: 물체 궤적(X-Sim), 물체 pose(Human2Sim2Robot), 비디오 유사도(Human2Bot) — 모두 시각 기반.

- 촉각 완전 부재: UMI, ACT-1을 포함한 전체 연구에서 촉각 정보를 사용하지 않는다.

- Gripper 편향: EgoZero, X-Sim, VidBot, UMI는 gripper 기반. Dexterous hand는 Human2Sim2Robot과 VideoDex만. ACT-1은 dexterous hand를 사용하나 Skill Transform 의존.

- Contact-rich 미검증: 나사 조이기, 캡핑, 정밀 조립 등은 거의 포함되지 않았다.

4.6 핵심 논의: Contact-rich의 벽

Teleop-free 접근의 성과는 인상적이지만, contact-rich 태스크에서의 체계적 공백이 존재한다. 그 원인은 명확하다:

- 시각 보상의 한계: 물체 궤적이나 pose는 접촉면의 힘 분포를 캡처하지 못한다. 캡핑 태스크에서 물체가 올바른 위치에 있더라도 토크가 부족하면 실패한다 — 이 실패를 시각 보상은 구별하지 못한다.

- Sim-to-real gap의 확대: 접촉 역학(contact dynamics)은 시뮬레이션에서 가장 부정확한 영역이다. 마찰, 변형, 표면 상태의 시뮬레이션 오류가 contact-rich 태스크에서 극대화된다.

- Pose estimation의 한계: Human2Sim2Robot 저자가 인정했듯이, 접촉면에서의 occlusion과 반사/투명 물체의 pose 추정 오류가 contact-rich에서 특히 심각하다.

UMI [8] [#35]는 컵 정리(100%)처럼 non-contact-rich 태스크에서 높은 성공률을 보였으나, 촉각 센서가 없어 contact-rich 태스크로의 확장은 미검증이다. ACT-1 [9] [#29]의 에스프레소 추출 시연은 contact-rich 잠재력을 시사하지만, 체계적 벤치마크가 부재하여 정량적 평가가 불가능하다. Skill Transform의 90% 성공률 이면의 10% 실패 케이스도 공개되지 않았다.

배포 관점에서, Habilis-β [10] [#33]는 TPH(시간당 태스크 수)와 MTBI(평균 개입 간격)라는 배포 지표를 제안하여, 단일 에피소드 성공률이 아닌 지속적 운용 효율을 평가했다. 시뮬레이션에서 π0.5 대비 4.75배 생산성 향상을 보고했다. 이는 contact-rich 성공률뿐 아니라 실제 배포 시 지속 가능한 운용성도 중요한 평가 축임을 상기시킨다.

이 분석에서 두 가지 경로가 도출된다:

4.7 우리의 방향과의 연결

Teleop-free 연구들은 TacGlove/TacTeleOp/TacPlay에 세 가지 시사점을 제공한다:

- Data B의 기본 가치 확인: X-Sim, EgoZero, VidBot이 사람 데이터만으로 의미 있는 정책을 학습할 수 있음을 보였다. TacTeleOp의 Data B 수집이 잠재적 가치를 가진다는 전제가 확인된다.

- 70% ceiling의 존재: EgoZero의 70%는 vision-only Data B의 실질적 상한선을 시사한다. 이 ceiling을 넘기 위해 촉각(Chapter 3)과 co-training(Chapter 5)이 필요하다.

- 촉각 보상의 기회: UMI, ACT-1을 포함한 전체 연구가 시각 보상에 의존하며, 촉각 보상은 시도조차 되지 않았다. TacPlay의 "촉각 목표 RL"은 이 빈 공간에 위치한다.

다음 장에서는 Data B만의 한계를 Data A와의 결합으로 극복하는 co-training 접근을 분석한다 (Chapter 5).

참고문헌

- Dan, P., et al. (2025). X-Sim: Cross-Embodiment Simulation for Robot Learning. CoRL 2025 Oral. https://portal-cornell.github.io/X-Sim/ scholar

- Lum, T. G. W., et al. (2025). Human2Sim2Robot: Dexterous Manipulation Transfer via Simulation. CoRL 2025. scholar

- Liu, V., et al. (2025). EgoZero: Robot Policy Learning from Egocentric Video without Robot Data. arXiv. scholar

- Chen, H., et al. (2025). VidBot: Learning Robot Manipulation from Internet Videos. CVPR 2025. scholar

- Ye, S., et al. (2025). LAPA: Latent Action Pretraining from Videos. ICLR 2025. scholar

- Shaw, K., et al. (2023/2024). VideoDex: Learning Dexterous Manipulation from Internet Videos. CoRL 2023 / IJRR 2024. scholar

- Ghunaim, Y., et al. (2025). Human2Bot: Zero-Shot Robot Learning from Human Videos. Autonomous Robots. scholar

- Chi, C., et al. (2024). Universal Manipulation Interface: In-The-Wild Robot Teaching Without In-The-Wild Robots. RSS 2024. #35 scholar

- Sunday, E. (2025). ACT-1: Humanoid Hand for Human-Level Manipulation. Physical Intelligence Blog. #29 scholar

- Habilis Team (2026). Habilis-β: On-Device VLA for Sustained Autonomous Operation. arXiv. #33 scholar