Chapter 2: 사람 손 데이터 수집 — 센서에서 데이터셋까지

요약

사람 손 데이터를 수집하는 하드웨어는 크게 네 가지로 분류된다: 모션 트래킹 글러브, 촉각 글러브, 웨어러블 외골격, 이고센트릭(egocentric) 카메라. 각 접근은 고유한 trade-off를 가지며, TacGlove가 제안하는 "stretchable 글러브 + 촉각 센서 + 스마트글래스" 조합의 설계 근거는 이 trade-off 분석에서 도출된다.

2.1 도입

Chapter 1에서 Data B의 가치를 확인했다면, 이 장의 질문은 "무엇으로, 어떻게 모을 것인가"이다. 2024~2026년 사이에 다양한 웨어러블 데이터 수집 시스템이 등장했으며, 이들은 수집 가능한 모달리티(관절각, 힘, 시각)와 운용 조건(비용, 착용감, 내구성)에서 크게 다르다.

2.2 모션 트래킹 글러브

Park et al. (2024) — Stretchable eGaIn 글러브

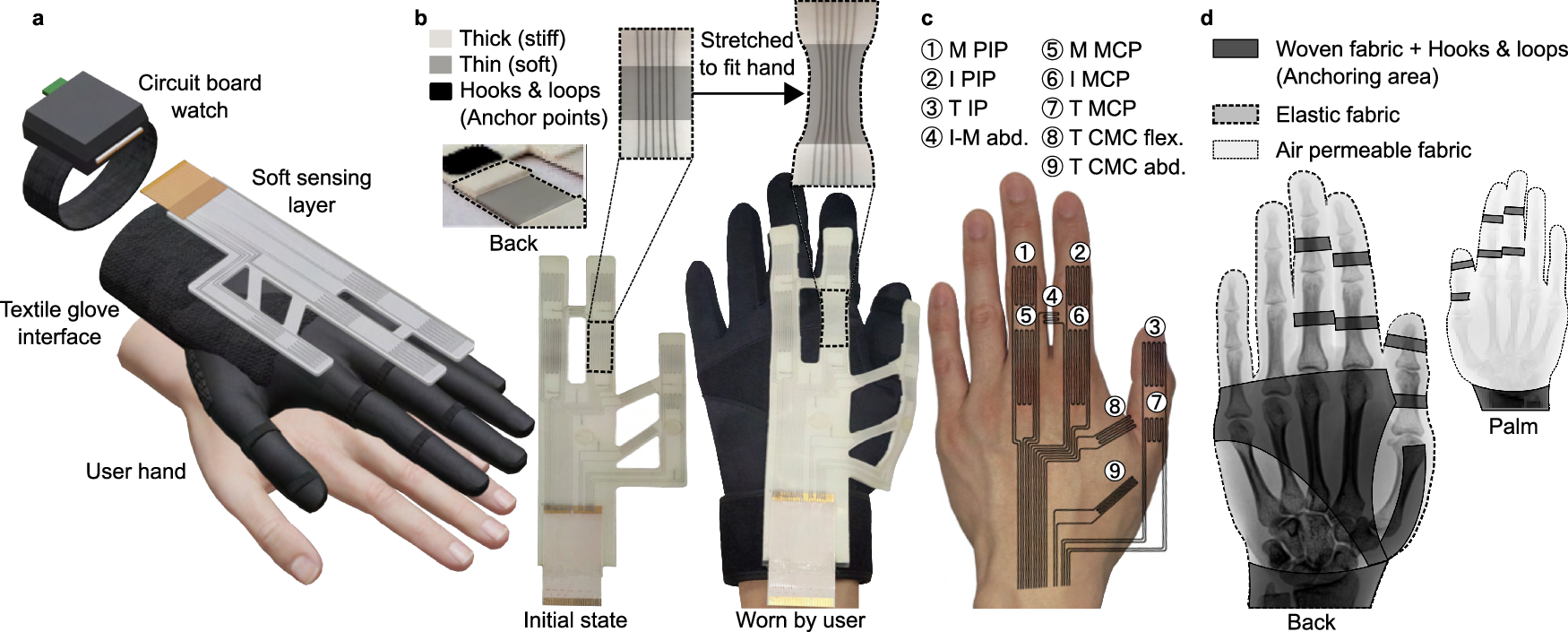

Park et al.[1] [#6]은 eGaIn(eutectic gallium-indium) 액체금속 센서 기반의 stretchable 글러브를 제안했다. 9개의 eGaIn 변형 센서가 손가락 관절 위에 배치되어 관절각과 뼈 길이를 동시에 추정한다.

| 지표 | 수치 |

|---|---|

| 뼈 길이 오차 | 2.1 mm |

| 관절각 오차 | 4.16° |

| 손끝 위치 오차 | 4.02 mm |

| 센서 수 | 9개 eGaIn |

| 커버리지 | 3손가락 (엄지, 검지, 중지) |

이 글러브의 핵심 장점은 stretchable 특성이다. 실리콘 기반이므로 자연스러운 파지를 방해하지 않으며, 다양한 손 크기에 적응 가능하다. 3D-printed 외골격이 가지는 변형·마모 문제(DexUMI의 저자가 인정한 한계)를 구조적으로 회피한다.

그러나 두 가지 핵심 한계가 있다: (1) 3손가락만 커버 — 약지와 소지가 빠져 whole-hand 조작 데이터 수집이 불가하다. (2) 촉각 센서 부재 — 관절각만 측정하며, 접촉 시 힘 정보를 캡처하지 않는다.

TacGlove [#26]는 이 글러브를 5손가락으로 확장하고, 8개 3축 자기 촉각 센서를 추가하는 것을 제안한다 (Chapter 7).

기타 모션 글러브: Manus, StretchSense

Manus Quantum과 StretchSense는 상용 모션 캡처 글러브로, 20+ DoF의 관절각을 제공한다. 이들은 VR 텔레오퍼레이션 시스템(Data A 수집)에 주로 사용된다. 문제는 이들이 텔레오퍼레이션 인터페이스로 설계되었다는 점이다 — 로봇 없이 독립적으로 사람 작업을 기록하는 Data B 수집에는 추가 설계가 필요하다.

2.3 촉각 글러브

촉각 글러브는 관절각뿐 아니라 접촉 시 힘(force) 정보까지 수집하는 시스템이다. 이 모달리티의 추가가 갖는 가치는 Chapter 3에서 상세히 다루며, 여기서는 하드웨어 비교에 집중한다.

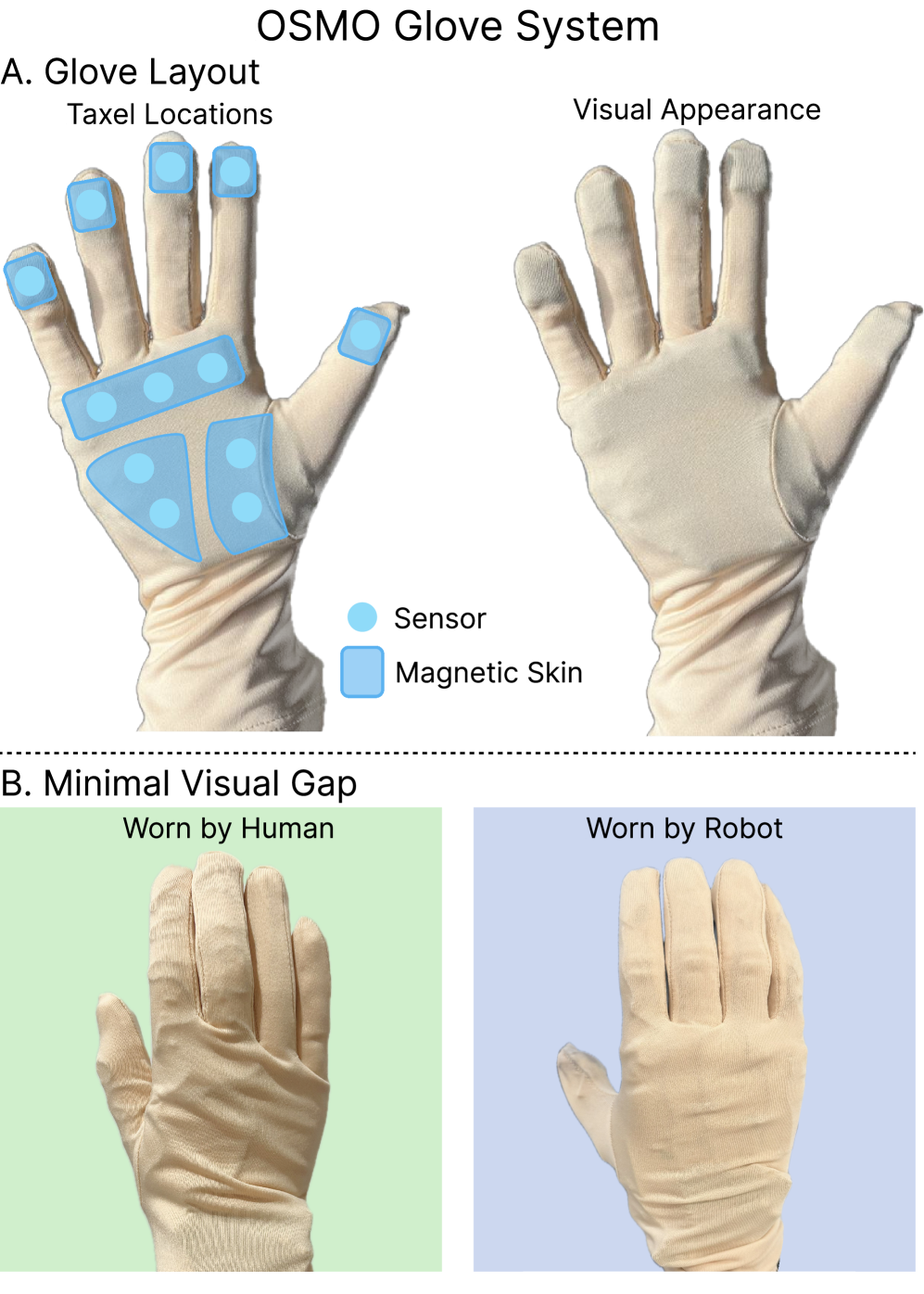

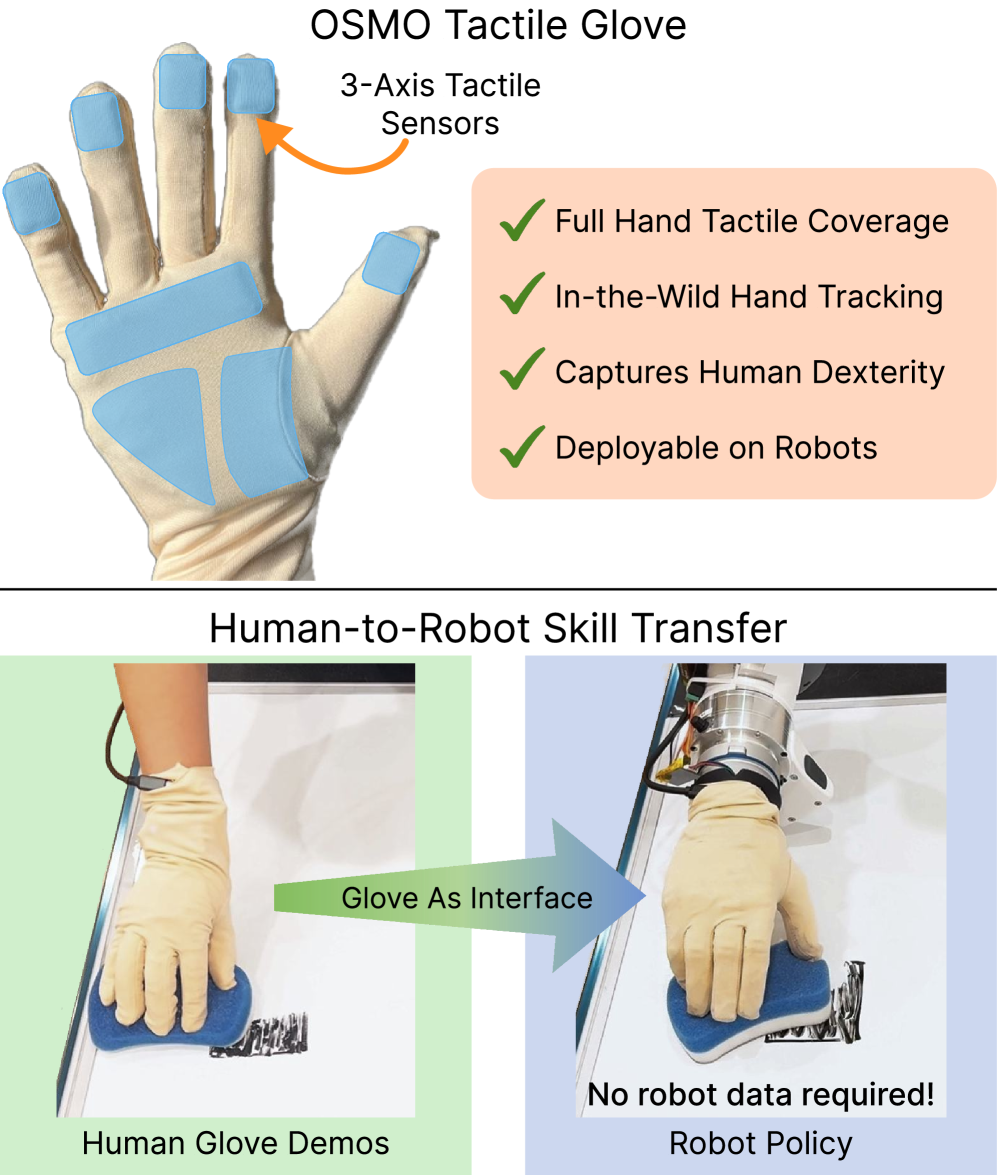

OSMO (Meta FAIR, 2025)

OSMO [2] [#18]는 현재까지 가장 완성도 높은 촉각 글러브 시스템이다. 12개의 3축 자기 촉각 센서(taxels)가 손가락 5개와 손바닥 3섹션에 배치되며, 자기 elastomer의 변형을 BMM350 자력계로 측정한다.

| 특성 | OSMO |

|---|---|

| 센서 유형 | 3축 자기 (magnetometer + magnetic elastomer) |

| 센서 수 | 12개 |

| 측정 범위 | 0.3 – 80 N |

| 노이즈 저감 | MuMetal 차폐 + 이중 자력계 차동 센싱 (57% 감소) |

| 호환 | Aria Gen 2, Quest 3, Apple Vision Pro, Manus Quantum 등 |

| 인간/로봇 공용 | Psyonic Ability Hand에 장착 가능 |

OSMO의 가장 중요한 기여는 Embodiment Bridge 개념이다. 동일한 물리적 글러브를 인간과 로봇 모두에 장착함으로써, 시각과 촉각의 embodiment gap을 물리적으로 해소한다. 이 개념은 TacGlove/TacTeleOp/TacPlay [#27]의 핵심 전제이기도 하다.

그러나 OSMO의 실험적 검증은 제한적이다: 1개 태스크(wiping), 140 demos(약 2시간), Psyonic Ability Hand 1종. 저자 스스로 "unimanual task with fairly limited dexterity"라고 인정했다. 대규모 다태스크 검증과 co-training 파이프라인은 아직 미구현이다 (Chapter 7-8에서 TacGlove/TacTeleOp의 차별화 논의).

Whole-hand 커버리지의 모달리티 스펙트럼

최근 OSMO와 동일한 whole-hand 목표를 서로 다른 모달리티·밀도로 구현한 두 시스템이 등장했다. [16]의 Sparsh-skin은 Allegro 손에 Xela uSkin 자기 택셀을 총 368개 배치(손바닥 3패드 4×6 그리드 + 손끝 4 + 팔란지 11)하여 약 100Hz로 샘플링한다. 이 구성의 핵심 메시지는 손바닥 패드를 제거했을 때 pose estimation 정확도가 10%p 이상 하락한다는 어블레이션 결과다 — "full-hand tactile perception is crucial"를 정량적으로 입증한다. 비전 기반으로는 [17]의 F-TAC Hand가 17개 VBTS로 손바닥 면적의 약 70%를 0.1 mm 해상도(~10,000 taxels/cm²)로 커버하며, multi-object 운반 실험에서 촉각 부재 시 53.5%에 머물던 적응률이 고해상도 손바닥 촉각을 활성화하면 거의 100%로 상승함을 보였다.

이 세 점 — OSMO(magnetic, 12채널), Sparsh-skin(magnetic, 368채널), F-TAC(vision, 0.1 mm) — 은 해상도·채널 수·모달리티의 세 축에서 whole-hand 촉각의 가능한 지점들을 서로 다르게 샘플링한다. TacGlove는 이 스펙트럼 위에서 "인간 착용 가능한 stretchable 폼팩터 + moderate 밀도 + 인간/로봇 공용"이라는 고유한 좌표를 점유한다 (Chapter 7).

VTDexManip (Zhejiang University, ICLR 2025)

VTDexManip [3]은 최초의 visual-tactile dexterous manipulation 데이터셋을 제시했다. 저비용 piezoresistive 압력 센서 글러브와 HoloLens2를 결합하여 5명 피험자, 10개 태스크, 182개 물체, 2,032 시퀀스(565K 프레임)를 수집했다.

핵심 결과는 binary 촉각 정보만으로도 RL 벤치마크에서 +20% 성능 향상을 달성했다는 것이다. Joint visual-tactile pretraining은 추가 +20%를 제공했다. 다만 이 결과는 시뮬레이션 기반이며 real-world 검증은 이루어지지 않았다.

TacCap (2025)

TacCap [4]은 FBG(Fiber Bragg Grating) 광학 센서 기반 thimble이다. 10⁻⁵ 수준의 변형 분해능과 최대 2kHz 샘플링, 전자기 간섭(EMI) 면역이 장점이지만, interrogator 장비가 고가이며 손끝만 커버한다는 한계가 있다.

DOGlove (Tsinghua, RSS 2025)

DOGlove [5]은 21-DoF 모션 캡처 + 5-DoF cable-driven 힘 피드백 + 5-DoF LRA 햅틱을 $600 이하에 구현했다. Press and Move Box 85%, Pick and Place Teddy Bear 70%의 성공률을 보고했다. 그러나 DOGlove는 텔레오퍼레이션 도구이지 데이터 수집 + 학습 시스템이 아니다 — 수집된 촉각 데이터를 학습에 사용한 실험은 없다.

촉각 글러브 비교

| 시스템 | 센서 유형 | 센서 수 | 축 | 인간/로봇 공용 | 비용 | 학습 실증 |

|---|---|---|---|---|---|---|

| OSMO | 자기 | 12 | 3축 | Yes | 미공개 | 72% (1태스크) |

| VTDexManip | piezoresistive | 다수 | binary | No | 저비용 | +20% (sim) |

| TacCap | FBG 광학 | 다수 | multi | Yes | 고가 | 미실시 |

| DOGlove | cable-driven | 5+5 | - | No (teleop) | <$600 | 85%/70% (teleop) |

| UMI-FT | CoinFT (정전용량 6축 F/T) | 2 (손가락당 1개) | 6축 | Yes (그리퍼) | 저비용 | Yes (ACP) |

2.4 웨어러블 외골격

외골격(exoskeleton)은 인간 손의 기구학을 기계적으로 캡처하는 접근이다. 글러브와의 핵심 차이는 관절각을 encoder로 직접 측정한다는 점이다.

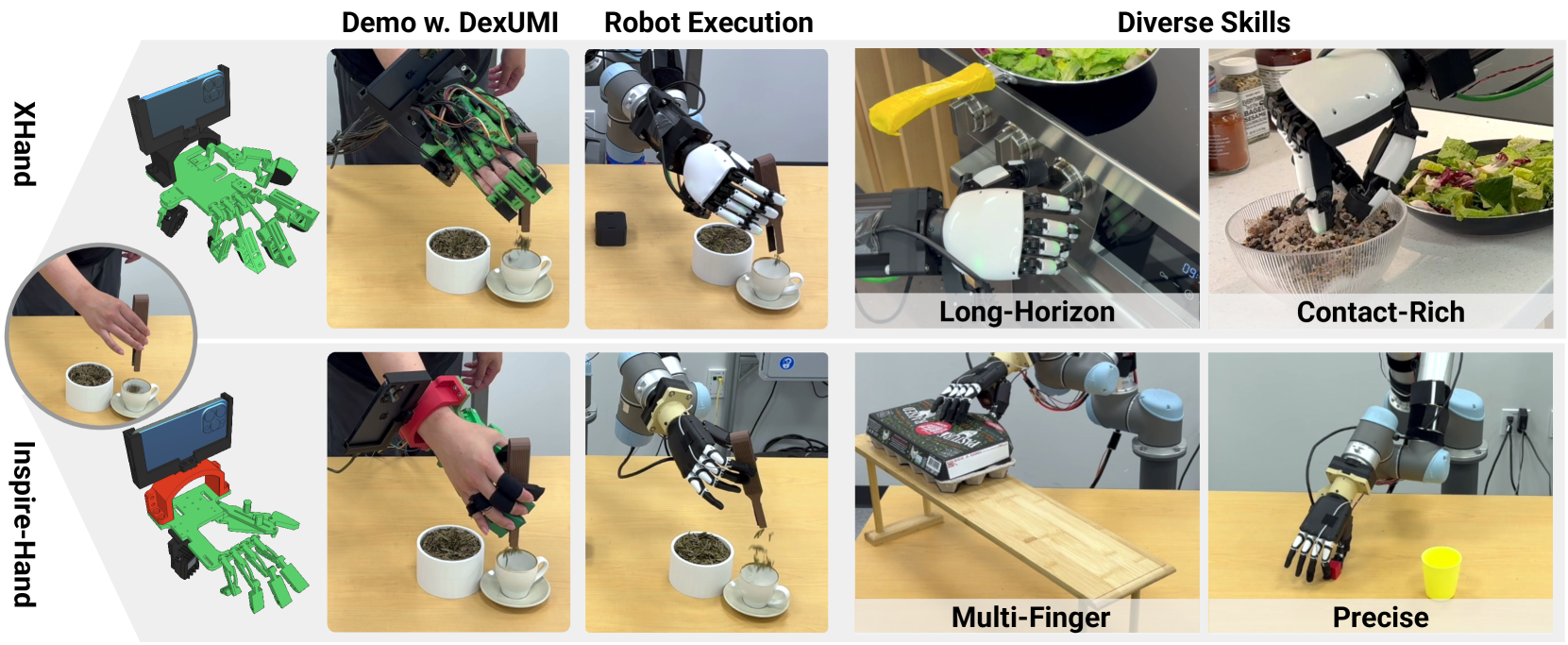

DexUMI (Stanford, 2025)

DexUMI [6] [#8]는 3D-printed 외골격 + encoder 조합으로 dexterous manipulation 데이터를 수집한다. 86%의 높은 성공률과 텔레오퍼레이션 대비 3.2배 빠른 수집 속도를 보고했다. 결정적으로, 촉각 센서가 있는 정책은 grasping에 성공했지만 없으면 실패했다는 ablation 결과를 제공했다.

한계는 3D-printed 부품의 변형 문제이다. 저자 스스로 encoder 부정확성의 원인으로 exoskeleton 변형을 지목했다. 또한 robot hand inpainting이 오프라인에서만 가능하여 실시간 시연이 제한된다.

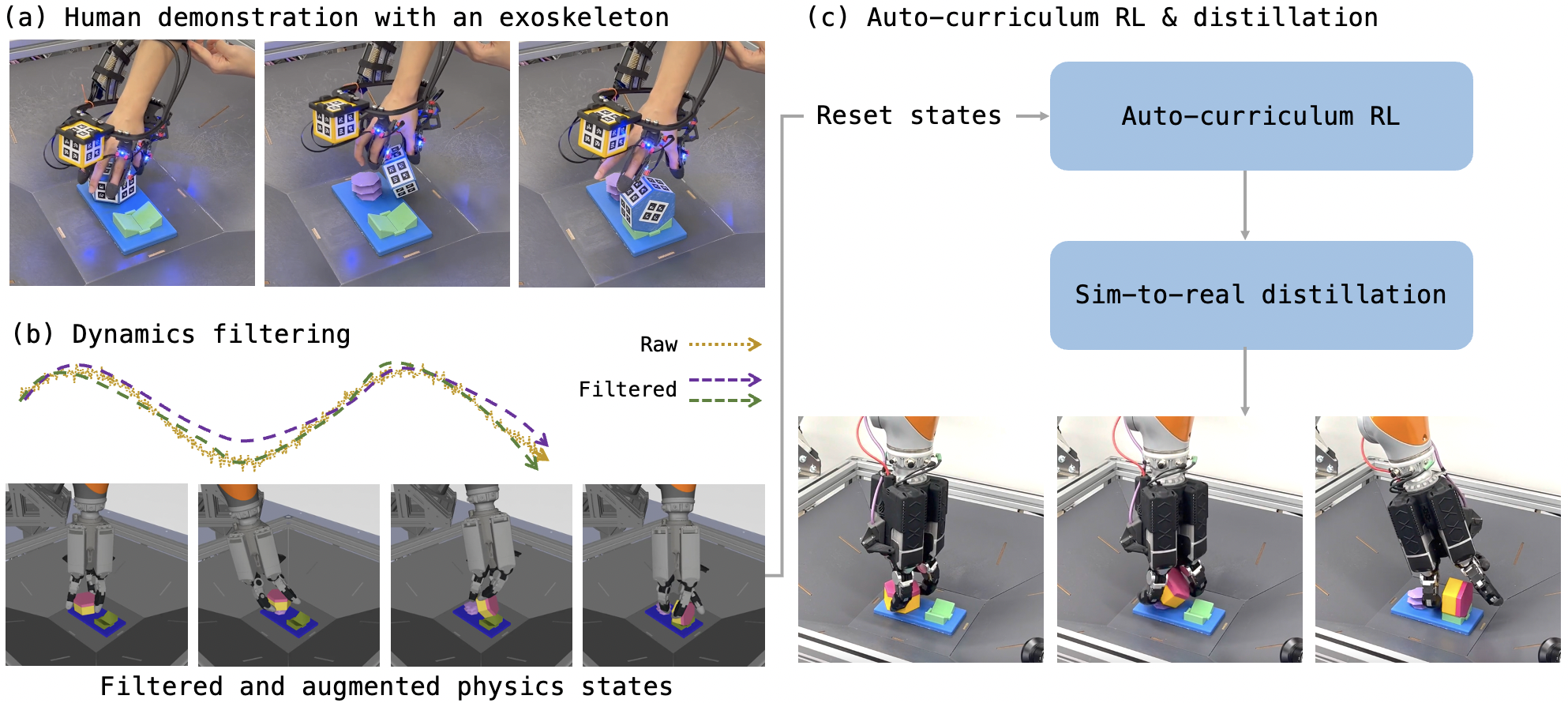

ExoStart (Google DeepMind, 2025)

ExoStart [7] [#9]는 저비용 외골격에서 9~15개 시연만 수집한 뒤 시뮬레이션에서 RL로 정책을 학습하는 파이프라인이다. AirPods case opening, key insertion 등의 태스크에서 >50% 성공률을 달성했으며, 텔레오퍼레이션 대비 8배 빠른 수집을 보고했다. dynamics filtering과 auto-curriculum RL이 핵심 기법이다.

UMI — 그리퍼 장착형 인터페이스 (Stanford, 2024)

UMI [14] [#35]는 외골격이나 글러브가 아닌 핸드헬드 그리퍼라는 독특한 접근을 취한다. 인간이 로봇과 동일한 2-DoF 그리퍼를 $371에 직접 쥐고 시연하며, GoPro 피쉬아이 카메라와 IMU 기반 SLAM으로 6-DoF 궤적을 추적한다. relative trajectory representation을 통해 수집 환경과 로봇이 달라도 정책 전이가 가능하다 — 실제로 UR5e와 Franka 두 로봇에 cross-robot 전이를 실증했다.

핵심 한계는 두 가지이다: (1) 2-DoF 그리퍼만 지원 — dexterous hand 조작은 불가하며, 단순 pick-and-place 수준에 머문다. (2) 촉각 센서 부재 — 접촉 힘 정보 없이 순수 시각 정책만 학습한다. 후속 연구 UMI-FT는 CoinFT 센서로 6축 F/T를 추가했으나, wrist 수준의 낮은 해상도에 그쳤다.

AirExo / AirExo-2 (SJTU, 2024/2025)

AirExo [8]와 AirExo-2 [9]는 $300/arm의 초저비용 수동 외골격이다. AirExo-2는 in-the-wild 데이터만으로 텔레오퍼레이션 수준의 성능을 달성했다. "3분 teleop + in-wild ≥ 20분 teleop only"라는 결과는 소량 로봇 데이터 + 대량 인간 데이터 조합의 효과를 명확히 보여준다. 다만 arm-level gripper 태스크에 한정되며 dexterous hand는 미지원이다.

웨어러블 비교

| 시스템 | 비용 | 유형 | 촉각 | Robot-free | Dexterous |

|---|---|---|---|---|---|

| DexUMI | 미명시 | Exo | 부분 | Yes | Yes |

| ExoStart | 저비용 | Exo | No | Yes | Yes |

| AirExo-2 | $0.6K | Passive exo | No | Yes | No (arm) |

| HumanoidExo | - | Exo | No | No | No (arm) |

| NuExo | 고가 | Active exo | 부분 | No | No (arm) |

2.5 이고센트릭 비디오 데이터셋

글러브나 외골격 없이 카메라만으로 사람 손 데이터를 수집하는 접근이다.

EgoDex (Apple, 2025)

EgoDex [10]는 Apple Vision Pro의 ARKit을 활용한 현존 최대 규모의 dexterous manipulation 데이터셋이다: 829시간, 9천만 프레임, 338,000 에피소드, 194개 태스크. 손가락별 30Hz 3D pose tracking이 핵심 강점이다. 그러나 lab/가정 환경에 한정되며, 촉각과 힘 정보는 완전히 부재한다.

Ego4D (Meta, 2022)

Ego4D [11]는 9개국 931명 참여자의 3,670시간 일상 비디오로, 후속 연구(PhysBrain, EgoScale)의 핵심 사전훈련 소스이다. 손 조작 특화가 아닌 일반 일상 비디오이므로 manipulation 관련 비율이 낮다는 한계가 있다.

BuildAI Egocentric-10K (2025)

BuildAI[12]는 실제 공장에서 수집한 최대 규모의 egocentric 데이터셋이다: 10,000시간, 108억 프레임, 2,153명 작업자, Apache 2.0 공개. PhysBrain[13]이 이를 VQA로 변환하여 53.9% SimplerEnv 성공률을 보고했다. 그러나 촉각과 per-finger hand tracking이 없어, 정밀 조작 학습에는 한계가 있다.

데이터셋 비교

| 데이터셋 | 규모 | 환경 | Hand Tracking | 촉각 | 산업 |

|---|---|---|---|---|---|

| EgoDex | 829hr | Lab/가정 | Per-finger 3D | No | No |

| Ego4D | 3,670hr | 일상 다양 | 제한적 | No | No |

| BuildAI | 10,000hr | 공장 | No | No | Yes |

2.6 핵심 논의: 무엇이 빠져 있는가

위의 분석에서 체계적 공백이 드러난다:

- 촉각의 부재: 16편의 데이터 수집 관련 논문 전체에서 촉각 데이터를 학습에 사용한 연구는 OSMO(1태스크)와 VTDexManip(sim)뿐이다. 대규모 촉각 데이터 수집 → 로봇 전이 파이프라인은 존재하지 않는다.

- 통합의 부재: 관절각(글러브), 촉각(촉각 센서), 시각(스마트글래스)을 동시에 수집하는 통합 시스템이 없다. 기존 연구는 각 모달리티를 독립적으로 활용한다.

- 산업 환경의 부재: BuildAI를 제외하면 모든 데이터셋이 lab/가정 환경에서 수집되었다. BuildAI도 촉각과 hand tracking이 없다.

UMI는 로봇 없는 데이터 수집의 실현 가능성을 성공적으로 실증했으나, 촉각 센싱과 dexterous hand 지원이 모두 부재하다 — 정확히 TacGlove가 해결하려는 gap이다.

TacGlove/TacTeleOp은 이 세 가지 공백을 해결하려는 시도이다: Park et al.[1]의 stretchable 글러브를 5손가락으로 확장하고 촉각 센서를 추가하며(Chapter 7, TacGlove), 이를 활용한 대규모 데이터 수집과 co-training 파이프라인을 구축한다(Chapter 8, TacTeleOp).

2.7 우리의 방향과의 연결

TacGlove의 하드웨어 설계는 위의 비교에서 다음과 같이 포지셔닝된다:

- Park et al.의 stretchable 특성 → 자연 파지 유지, 공장 내구성 (DexUMI의 3D-printed 변형 문제 회피)

- OSMO의 3축 자기 센서 → 인간-로봇 공용 Embodiment Bridge (동일 촉각 공간)

- AoE의 always-on 패러다임 → 작업자가 상시 착용하며 자연 데이터 수집

- BuildAI 대비 modality richness → 규모(800hr vs 10,000hr)에서는 열세이나, 촉각 + per-finger tracking으로 차별화

다음 장에서는 이 촉각 모달리티가 왜 필수적인지를 정량적으로 분석한다 (Chapter 3).

참고문헌

- Park, M., & Park, Y.-L. et al. (2024). Stretchable Glove for Hand Motion Estimation. Nature Communications. https://www.nature.com/articles/s41467-024-50101-w #6 scholar

- Yin, J., et al. (2025). OSMO: A Large-Scale Tactile Glove for Human-to-Robot Manipulation Transfer. arXiv. https://arxiv.org/abs/2512.08920 #18 scholar

- Liu, Q., et al. (2025). VTDexManip: Visual-Tactile Dexterous Manipulation Dataset. ICLR 2025. scholar

- Ren, T.-A., et al. (2025). TacCap: FBG-Based Optical Tactile Thimble. arXiv. scholar

- Zhang, H., et al. (2025). DOGlove: Open-Source Haptic Feedback Glove. RSS 2025. scholar

- Xu, M., et al. (2025). DexUMI: Universal Manipulation Interface for Dexterous Hands. arXiv. #8 scholar

- Si, Z., et al. (2025). ExoStart: Exoskeleton-Aided Dexterous Manipulation from One Demo. arXiv. #9 scholar

- SJTU (2024). AirExo: Low-Cost Exoskeletons for Learning Whole-Arm Manipulation in the Wild. ICRA 2024. scholar

- SJTU (2025). AirExo-2: In-the-Wild Data Collection for Robot Learning. CoRL 2025 Oral. scholar

- Hoque, R., et al. (2025). EgoDex: Egocentric Dexterous Manipulation Dataset. arXiv. scholar

- Grauman, K., et al. (2022). Ego4D: Around the World in 3,000 Hours of Egocentric Video. CVPR 2022. scholar

- BuildAI (2025). Egocentric-10K: Factory Egocentric Video Dataset. Hugging Face. scholar

- PhysBrain (2025). Egocentric2Embodiment Pipeline. arXiv. scholar

- Chi, C., et al. (2024). Universal Manipulation Interface: In-The-Wild Robot Teaching Without In-The-Wild Robots. RSS 2024. https://umi-gripper.github.io/ #35 scholar

- Chi, C., et al. (2025). UMI on Legs: Making Manipulation Policies Mobile with Manipulation-Centric Whole-body Controllers. arXiv. scholar

- Sharma, A., et al. (2025). Self-supervised perception for tactile skin covered dexterous hands (Sparsh-skin). arXiv. https://arxiv.org/abs/2505.11420 scholar

- Zhao, Z., et al. (2025). Embedding high-resolution touch across robotic hands enables adaptive human-like grasping (F-TAC Hand). Nature Machine Intelligence. https://arxiv.org/abs/2412.14482 #39 scholar