Chapter 5: 텔레옵과 사람 데이터의 시너지 — Co-training

요약

인간 데이터(Data B)와 로봇 데이터(Data A)의 co-training은 단독 사용 대비 일관되게 우월하다: EgoMimic +34~228%, EgoScale R²=0.9983 log-linear scaling, AoE 45%→95%(Close Laptop 태스크), DEXOP 0.513>0.425. 더 나아가, pi0은 대규모 학습에서 인간-로봇 표현의 emergent alignment을 발견했다. 그러나 대부분의 co-training 연구는 촉각을 사용하지 않으며, UMI-FT가 손목 수준 힘/토크 센싱으로 첫 신호를 보였으나 분산 촉각(distributed tactile) 규모의 co-training은 미탐색 영역이다.

5.1 도입

Chapter 4에서 Data B만으로 70% 수준에 도달할 수 있음을 확인했다. 이 장의 질문은 "Data A를 추가하면 얼마나 더 올라가는가?"이다. 이것은 TacTeleOp [#26] 가설 H2에 해당하며, 기존 연구가 가장 풍부한 근거를 제공하는 영역이다.

Co-training의 핵심 아이디어는 단순하다: Data B는 "무엇을 해야 하는지"를 가르치고, Data A는 "이 로봇이 어떻게 해야 하는지"를 가르친다. Data B는 규모와 현실성을, Data A는 실행 가능성(executability)과 정렬(alignment)을 제공한다.

5.2 Co-training의 정량적 증거

EgoMimic: "1시간 hand > 2시간 robot" (Georgia Tech, 2024)

EgoMimic [1]은 co-training 패러다임을 연 선구적 연구이다. Project Aria 글래스로 egocentric 인간 데이터를 수집하고, 인간-로봇 kinematic gap을 최소화한 저비용 bimanual manipulator에서 co-train했다.

| 비교 | 결과 |

|---|---|

| 2hr robot + 1hr hand vs 3hr robot (ACT) | +34~228% (태스크별) |

| 핵심 발견 | 동일 시간 대비 human data가 robot data보다 높은 한계 성능 |

이 결과의 핵심은, 동일 시간을 투자할 때 사람 손 데이터가 로봇 텔레오퍼레이션 데이터보다 더 높은 한계 성능에 도달하는 scaling trend를 보인다는 것이다. 이것은 TacTeleOp의 "800시간 작업자 데이터 수집" 전략의 가장 직접적 정당화이다.

한계: 3개 태스크만 검증, custom robot(범용 로봇 미검증), gripper/bimanual 기반(dexterous hand 미검증), 촉각 미사용.

EgoScale: Log-linear Scaling Law (NVIDIA, 2026)

EgoScale [2]은 co-training의 이론적 기반을 확립했다. 20,854시간의 egocentric 인간 비디오에서 flow-based VLA를 pretrain하고, 소량 aligned human-robot data로 mid-training한 결과:

| 지표 | 수치 |

|---|---|

| Scaling law | Log-linear, R² = 0.9983 |

| vs no pretraining | +54% |

| Cross-robot transfer | lower DoF 로봇에도 효과적 |

R² = 0.9983은 인간 데이터의 양과 성능 사이의 관계가 거의 완벽한 예측 가능성을 가짐을 의미한다. 이것은 데이터 투자의 ROI를 사전에 계산할 수 있다는 것이며, TacTeleOp의 "800시간 투자"의 기대 효과를 추정할 수 있는 근거이다.

핵심 질문: 촉각 데이터의 scaling law도 log-linear인가? EgoScale은 vision-only이다. 촉각의 정보 밀도가 시각과 다르다면, scaling curve도 다를 수 있다 — 더 빠르게 수렴하거나(적은 데이터로 충분), 더 느리게 수렴할(더 많은 데이터 필요) 가능성이 모두 열려 있다. 이것은 TacTeleOp의 핵심 연구 질문 중 하나이다 (Chapter 10).

AoE: 소량 teleop + 대량 human의 극적 효과 (2026)

AoE [3]는 TacTeleOp의 시나리오를 가장 직접적으로 실증한 연구이다. $20 스마트폰 목걸이로 always-on egocentric 데이터를 수집하고, FLARE framework로 co-training했다.

| 태스크 | Teleop only (50) | + AoE (200 demos) |

|---|---|---|

| Pick and Place | 45.0% | 75.0% |

| Close Laptop | 45.0% | 95.0% |

| Fold Scarf | - | 10.0% (HW latency) |

| Push Bowl & Pour Seed | 0.0% | 20.0% |

특히 ablation에서 10 teleop + 200 AoE = 0%→55% (Close Laptop)라는 결과는, 최소한의 로봇 데이터만으로도 대량 인간 데이터의 극적 효과를 끌어낼 수 있음을 보여준다.

TacTeleOp 연결: AoE의 50 teleop + 200 human → 45%→95%(Close Laptop 태스크)는 TacTeleOp의 "소량 Data A(50~100 teleop) + 대량 Data B(50,000+ demos)" 시나리오를 정확히 실증한다. Pour Seed의 20%는 vision-only co-training의 contact-rich 한계를 보여주며, 이 gap이 촉각 추가의 기회 영역이다.

DEXOP: 외골격 데이터 + 소량 teleop (MIT, 2025)

DEXOP [4] [#10]은 passive exoskeleton으로 수집한 데이터와 teleop 데이터를 혼합했다:

| 비교 | 성공률 |

|---|---|

| 160 exo + 40 teleop | 0.513 |

| 200 teleop only | 0.425 |

| 수집 시간 차이 | 시간 절반 |

"비로봇 데이터 소스 + 소량 로봇 데이터 > 순수 로봇 데이터"라는 패턴이 EgoMimic, AoE와 일치한다.

pi0: Emergent Alignment at Scale (Physical Intelligence, 2025)

pi0 [5] [#2]은 대규모 heterogeneous 데이터(인터넷 비전-언어 + 로봇 + 인간 비디오)에서 VLA를 pretrain하고 co-finetuning한 결과, 명시적 정렬 없이 인간-로봇 표현이 자동으로 수렴하는 emergent alignment을 발견했다.

| 지표 | 수치 |

|---|---|

| Co-finetuning 효과 | 4개 시나리오에서 2x 개선 |

| Emergent alignment | 인간 손-로봇 gripper 표현 자동 수렴 |

이 발견은 근본적 질문을 제기한다: 충분한 규모의 데이터가 있으면, 명시적 retargeting이나 alignment loss 없이도 인간-로봇 gap이 자동 해소되는가? 만약 그렇다면 TacTeleOp의 explicit cross-embodiment retargeting(Stage 2)이 불필요할 수 있다.

그러나 세 가지 핵심 제약이 있다: (1) pi0는 산업 규모 compute를 요구하며 학술 연구실에서 재현 불가. (2) Gripper에서만 관찰되었으며 dexterous hand에서는 미검증. (3) 촉각 modality에서 emergent alignment이 발생하는지 미탐색. 세 번째 제약이 특히 중요하다 — 촉각에서도 emergent alignment이 발생하는지 여부는 TacTeleOp이 탐색할 수 있는 새로운 연구 질문이다.

DexWM: World Model 접근 (Meta FAIR, 2025)

DexWM [6]은 900+시간의 인간/로봇 비디오에서 world model을 학습하고 MPC로 dexterous manipulation을 수행했다. Zero-shot grasping에서 83% 성공률, Diffusion Policy 대비 +50% 향상.

World model 접근은 co-training의 또 다른 형태이다: 인간 데이터에서 물리 세계의 dynamics를 학습하고, 이를 로봇 행동 계획에 활용한다. TacPlay [#27]의 자율 탐색에서 world model을 활용하면, 촉각 상태(tactile state)를 포함한 더 정확한 contact prediction이 가능할 것이다.

UMI-FT: 힘/토크 센싱을 포함한 첫 Co-training 신호 (Columbia/Stanford, 2026)

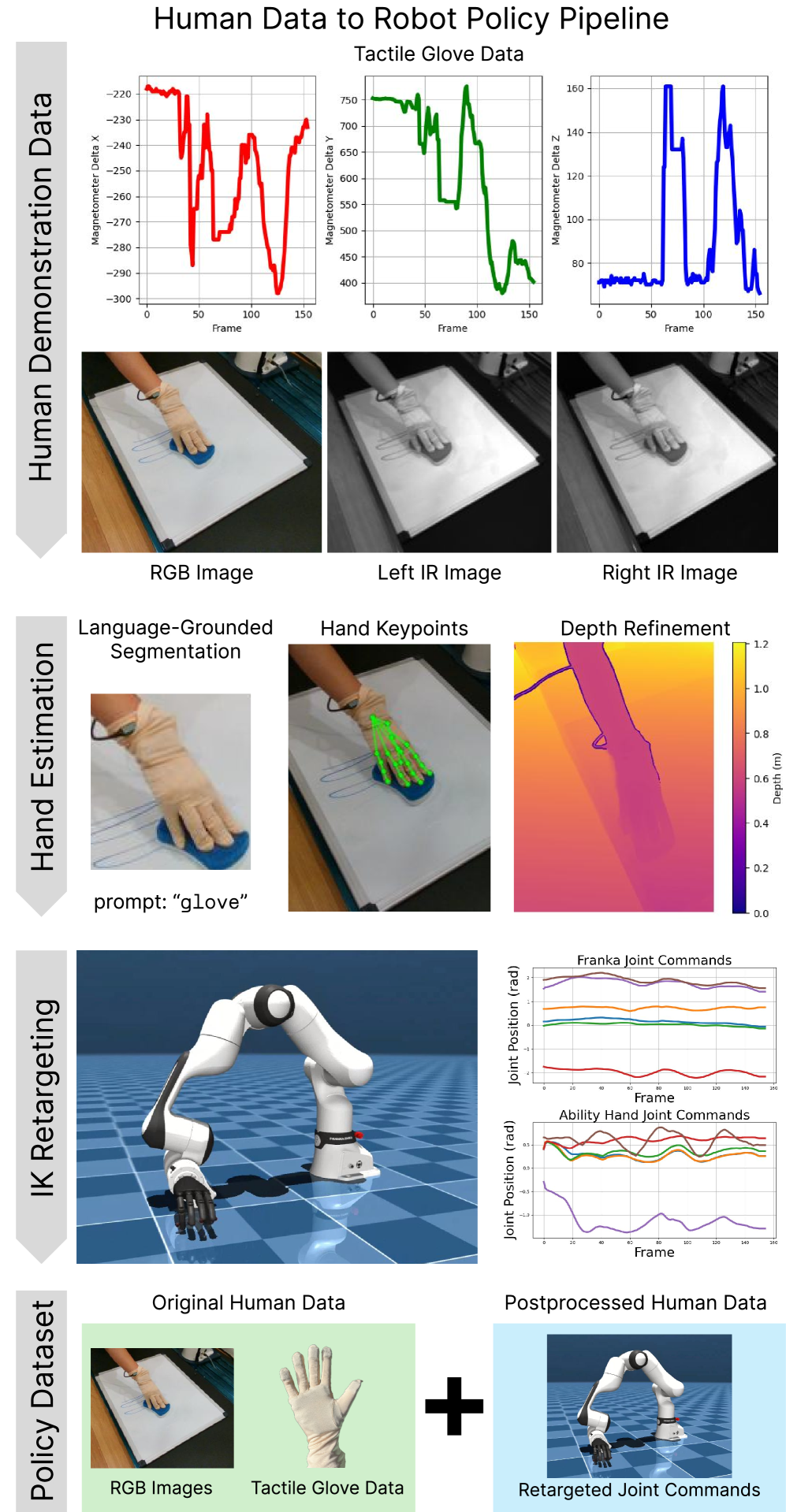

UMI-FT [10] [#36]는 UMI(Chapter 4) 핸드헬드 그리퍼에 CoinFT — 2g, 직경 20mm, 두께 3mm의 정전용량 기반 6축 힘/토크 센서 — 를 각 손가락에 장착하여, 야외 시연 데이터에 접촉력 정보를 포함시킨 최초의 연구이다.

| 태스크 | ACP (촉각+컴플라이언스) | DP+Force | DP only |

|---|---|---|---|

| 화이트보드 닦기 | 92% | 28% | 16% |

| 전구 삽입 | 95% | 60% | 0% |

| 호박 꼬치 (wild 데이터) | 100% | — | 20% |

핵심 발견은 Adaptive Compliance Policy(ACP)이다: 참조 자세(9D), 가상 목표 자세(9D), 강성 스칼라, 그리퍼 폭, 파지력 목표를 동시에 예측하여, 접근 시에는 유연하게(낮은 강성), 삽입 시에는 단단하게(높은 강성) 제어를 전환한다. 이것은 단순 위치 제어(DP only: 전구 삽입 0%)로는 불가능한 접촉-풍부 태스크에서 힘 정보가 결정적임을 보여준다.

TacTeleOp 연결: UMI-FT는 gripper 손가락(2개) 수준의 힘/토크 센싱이 co-training의 contact-rich 성능을 극적으로 개선함을 실증했다. 그러나 UMI-FT의 센서는 손목 수준 6축 F/T 센서 2개에 그치며, TacGlove가 제공하는 5손가락 24채널 분산 촉각과는 정보 밀도에서 질적 차이가 있다. "2개 센서로 0%→92%라면, 24채널 분산 촉각으로는 어떤 양상을 보이는가?"가 TacTeleOp이 답할 새로운 질문이다.

5.3 Co-training 효과의 공식화

위의 결과를 종합하면 co-training의 효과를 다음과 같이 공식화할 수 있다:

Data B = scale + realism ("무엇을/어떤 힘으로")

Data A = executability + alignment ("이 로봇이 어떻게")

Data A + Data B > Data A alone (EgoMimic, DEXOP)

Data A + Data B > Data B alone (X-Sim, EgoZero의 70% ceiling)

소량 A + 대량 B ≈ 최적 (AoE, DEXOP)

EgoScale이 보인 log-linear scaling은 이 효과가 Data B 양에 비례하여 예측 가능하게 증가함을 의미한다.

5.4 비교 분석

| 연구 | Human Data | Robot Data | 방법 | 핵심 결과 | 촉각 |

|---|---|---|---|---|---|

| EgoMimic | Aria(시각) | teleop | Co-train | +34-228% | No |

| EgoScale | 20,854hr ego | mid-train | Pretrain+finetune | +54%, R²=0.9983 | No |

| AoE | 200 demos | 50 teleop | Co-train (FLARE) | 45→95% (Close Laptop) | No |

| DEXOP | 160 exo | 40 teleop | 혼합 학습 | 0.513>0.425 | No |

| pi0 | internet+human | robot | Co-finetuning | 2x, emergent | No |

| DexWM | 829hr human | 100hr robot | World model | 83% grasping | No |

| UMI-FT | 야외 시연(힘 포함) | 0 | Diffusion+ACP | 92% wiping, 95% bulb | Wrist F/T |

UMI-FT를 제외한 전체 연구가 촉각을 사용하지 않으며, UMI-FT도 손가락당 1개의 6축 F/T 센서(총 2개)에 그친다. 분산 촉각(distributed tactile) 수준의 co-training은 완전히 미탐색이다. 이것이 TacTeleOp의 핵심 기회이다.

5.5 핵심 논의: 촉각 co-training의 미탐색

Co-training이 작동한다는 것은 확립된 사실이다. UMI-FT가 손목 수준 힘/토크 센싱으로 첫 돌파구(화이트보드 닦기 16%→92%)를 열었지만, 현재까지의 대부분의 co-training은 vision-only이며, 분산 촉각을 포함한 co-training이 어떤 양상을 보이는지는 열린 질문이다:

- 촉각 데이터의 scaling law: EgoScale의 시각 log-linear가 촉각에서도 성립하는가? 촉각이 시각보다 정보 밀도가 높다면 더 빠르게 수렴할 수 있다 — 적은 데이터로도 큰 효과.

- 촉각에서의 emergent alignment: pi0에서 관찰된 시각적 emergent alignment이 촉각에서도 발생하는가? OSMO의 Embodiment Bridge가 이를 가속할 수 있는가?

- 최적 비율: Data B(촉각 포함)와 Data A의 최적 혼합 비율은? Vision co-training과 동일한가?

- Contact-rich 태스크에서의 차별화: Vision-only co-training이 AoE Pour Seed에서 20%에 머물고, UMI-FT가 2개 F/T 센서로 이를 극복했다면, 24채널 분산 촉각은 추가적 향상을 보이는가?

UMI-FT는 "힘 정보가 contact-rich co-training에서 결정적"이라는 첫 정량적 증거를 제공했다. 그러나 UMI-FT의 센서 구성(gripper 손가락당 6축 F/T 1개)과 TacGlove의 분산 촉각(5손가락 24채널)은 정보 밀도에서 질적으로 다르다. "분산 촉각을 포함했을 때 co-training의 scaling law와 성능 ceiling이 어떻게 달라지는가"는 여전히 열린 질문이며, 이것이 TacTeleOp의 핵심 과학적 기여가 된다.

5.6 우리의 방향과의 연결

TacTeleOp은 이 장에서 확인된 co-training의 효과를 촉각 도메인으로 확장한다:

- Stage 1 (B pretrain): 800시간의 촉각+시각 작업자 데이터로 사전훈련

- Stage 2 (Retargeting): UniTacHand [#16] UV map 기반 촉각 정렬

- Stage 3 (A fine-tune): 50~100 teleop demos로 미세조정

EgoMimic이 vision co-training의 효과를 보였다면, TacTeleOp은 tactile co-training의 효과를 보이는 것이 목표이다. EgoScale이 vision scaling law를 실증했다면, TacTeleOp은 tactile scaling law를 탐색한다 (Chapter 8, Chapter 10).

참고문헌

- Kareer, S., et al. (2024). EgoMimic: Scaling Imitation Learning via Egocentric Video. arXiv. https://arxiv.org/abs/2410.24221 scholar

- Zheng, R., et al. (2026). EgoScale: Egocentric Video Pretraining for Scalable Robot Learning. arXiv. https://research.nvidia.com/labs/gear/egoscale/ scholar

- Yang, B., et al. (2026). AoE: Always-on Egocentric Data Collection for Robot Learning. arXiv. scholar

- Fang, H.-S., et al. (2025). DEXOP: Dexterous Manipulation with Passive Exoskeleton. IEEE RA-L. #10 scholar

- Physical Intelligence (2025). pi0: A General-Purpose Robot Policy. arXiv. #2 scholar

- Goswami, R. G., et al. (2025). DexWM: Dexterous World Models from Human and Robot Data. arXiv. scholar

- Yang, R., et al. (2025). EgoVLA: Egocentric Vision-Language-Action Model. arXiv. scholar

- PhysBrain (2025). Egocentric2Embodiment Pipeline. arXiv. scholar

- RoboWheel (2024). HOI-Based Cross-Embodiment Robot Learning. arXiv. scholar

- Chi, C., et al. (2026). In-the-Wild Compliant Manipulation with UMI-FT. arXiv. #36 scholar